AI開発、特に画像認識プロジェクトの品質保証(QA)において、顔認識、医療画像診断、採用支援システムなど、人に関わる画像データを扱う際、「公平性(Fairness)」は必須要件となります。

実際の開発現場では、バイアス評価が特定の担当者に依存していたり、個人の感覚に頼っていたりするケースが少なくありません。「どの指標を確認すべきか」「精度を維持したままどのように補正すればよいのか」といった課題に対し、専門的な論文を読み解く時間を確保することが難しい場合もあるでしょう。

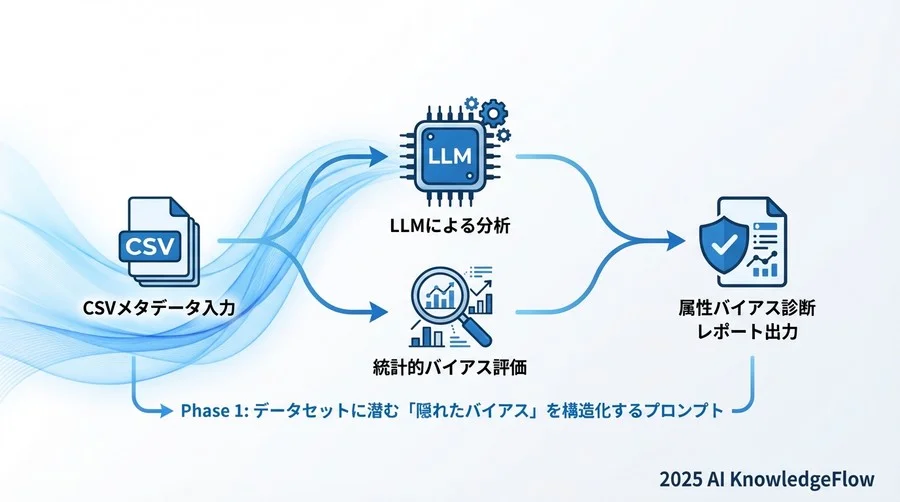

そこで本記事では、LLM(大規模言語モデル)を活用し、バイアスの検知から実装、報告までのプロセスを自動化する現実的なワークフローをご提案します。実務にすぐ組み込めるプロンプトテンプレートもご紹介しますので、既存の業務フローの改善にお役立てください。

本プロンプトセットの活用目的と前提条件

品質保証(QA)プロセスにLLMを導入する主な目的は、属人化しやすいバイアス評価の工程を標準化し、システム全体のリスクを早期に低減することです。画像認識AIの開発において、モデルの客観的な評価は不可欠ですが、人間の目視確認だけではどうしても見落としが発生しやすくなります。そこで、LLMを分析のアシスタントとして活用し、評価の網羅性を高めながら、効率的で運用しやすい検証サイクルを構築するアプローチについて解説します。

なぜ「属性バイアス」がリリース判定のブロッカーになるのか

従来の画像認識モデルの開発現場では、データセット全体の精度(AccuracyやF1-scoreなど)が主な評価指標とされてきました。しかし、全体の精度が十分に高く見えても、特定のグループ(例えば、暗い肌色の女性や特定の年齢層など)に対して著しく認識精度が低い場合、重大な倫理的リスクにつながる可能性があります。これが「属性バイアス」と呼ばれる問題です。

このバイアスが持つ最大の問題点は、「見えにくい」という性質にあります。テストデータセット全体の統計値だけを確認していても、特定の属性に対する不均衡には気づくことができません。さらに、バイアスが発覚したとしても、それを適切に補正するための技術(再サンプリングや敵対的バイアス除去など)を実装するには、高度な専門知識と多くの試行錯誤が必要です。このような見落としや対応の遅れが、リリース直前の大幅な手戻りや、最悪の場合は公開後の社会的な信用低下リスクに直結する傾向があります。

LLMを活用したバイアス検知・補正のワークフロー

今回ご紹介する実践的なアプローチは、LLMに特定の役割を任せることで、QA担当者の作業負担を大幅に軽減しつつ、評価の質を組織全体で標準化するものです。システム全体を俯瞰し、以下の3つのフェーズで検証を進めていきます。

- 検知(Phase 1): データセットのメタデータをLLMに分析させ、リスクとなり得る属性の偏りを定量的に指摘させます。

- 実装(Phase 2): 検知されたバイアスの状況に合わせて、最適な補正処理を行うためのPythonコードを自動生成させます。

- 報告(Phase 3): 補正前後の結果を解釈し、開発チームや関係者に向けた、専門用語を抑えた分かりやすいレポート案を作成させます。

前提となるデータセット形式とPython環境

本記事で提供するプロンプトは、以下の環境や条件が整っていることを想定して設計しています。運用のしやすさと保守性を考慮し、適切な環境を準備することが重要です。

- メタデータ: 画像ファイル名と、それに紐づく属性情報(年齢、性別、肌の色調など)が整理されたCSVまたはJSON形式のデータセットが存在すること。

- ライブラリ:

Fairlearn、AIF360、およびPyTorchやTensorFlowの最新安定版を使用する環境。- ※PyTorchなどの深層学習ライブラリは頻繁に更新されます。ハードウェアアクセラレーションを利用してモデルの最適化を行う場合は、必ず公式サイトで最新の互換性を確認してください。

- LLM: 複雑なコード生成と高度な論理推論に対応できる、強力なモデルの利用。

- ※OpenAIの公式情報によると、以前利用されていたGPT-3.5やGPT-4などの旧モデルは、現在完全に廃止されています。そのため、現在はCustom GPTsの活用や、新規チャットから具体的な背景とタスクを直接入力するプロンプトエンジニアリングの基本原則に従ったワークフローが推奨されます。

- ※公式の専用テンプレートは提供されていないため、明確で具体的な指示を与えることが評価精度を高める鍵となります。Claude 3.5 Sonnetなどの高性能モデルや、OpenAIの最新モデルを選択してください。利用可能な最新のモデルや機能の詳細については、各サービスの公式ドキュメントで最新情報を確認することをおすすめします。

具体的なフェーズごとに、実務ですぐに活用できるプロンプトの構成とベストプラクティスを順を追って確認します。

Phase 1:データセットに潜む「隠れたバイアス」を構造化するプロンプト

バイアス対応の第一歩は、現状を「正確に把握すること」です。単に「男性と女性」の比率を見るだけでは十分ではありません。「若い男性」は多いが「高齢の女性」は極端に少ないといった、複数の属性が交差する部分(交差属性)の不均衡こそが、モデルの公平性を大きく損なう原因となります。

メタデータ分析による属性不均衡の抽出

以下のプロンプトは、データセットの統計情報(pandas.DataFrame.describe() の出力など)を入力として、リスク評価を行わせるためのものです。

【プロンプトテンプレート:データ分布診断レポート生成】

## Role

あなたはAI公平性の専門家であり、厳格なデータ監査員です。

## Goal

提供された画像データセットのメタデータ統計情報を分析し、モデルの学習に悪影響を及ぼす可能性のある「属性バイアス」と「不均衡」を特定してください。

## Input Data

データセットの統計概要:

{{dataset_statistics_summary}}

(ここには df.describe(include='all') や各属性のvalue_counts()の結果を貼り付けます)

## Instructions

以下の観点で分析を行い、Markdown形式でレポートを出力してください。

1. 単一属性の不均衡: 各属性(性別、年齢層など)における主要クラスと少数クラスの比率を指摘し、1:5を超えるような極端な不均衡がある場合は警告してください。

2. 交差属性(Intersectionality)のリスク: 複数の属性を組み合わせた際(例: 性別 × 年齢)、データ数が極端に少ない、または欠損しているグループを特定してください。

3. 推奨される対処方針: 発見された不均衡に対し、データ収集の追加が必要か、データ拡張(Augmentation)で対応可能か、サンプリング手法の工夫で対応すべきか助言してください。

## Output Format

## 1. 属性分布の健全性評価

- 総合スコア: (A/B/C/D評価)

- 判定理由:

## 2. 特定されたリスク要因

- [高リスク] 属性グループ: {属性名} (比率: XX%)

- 解説: なぜこれがモデル精度に悪影響を与えるか

## 3. 交差バイアスの検出

- {属性A} × {属性B} の組み合わせにおける分布:

- {グループ名}: {件数}件 (全体比 XX%) -> [判定: 危険/注意/安全]

## 4. QA担当者への推奨アクション

- [ ] アクション1

- [ ] アクション2

なぜこのプロンプトが有効か

このプロンプトの重要なポイントは、単なる数値の羅列ではなく、「危険・注意・安全」といった具体的な判定と解釈を求めている点です。また、交差属性への言及を必須とすることで、単純な集計では見落としがちな少数派グループのデータ不足を視覚的に分かりやすく可視化できます。

QA担当者は、この出力結果を基に「この属性の組み合わせについては、重点的にテストケースを作成する必要がある」といった、実務に即した具体的な判断を下せるようになります。

Phase 2:最適な「バイアス自動補正技術」を選定・実装するプロンプト

バイアスを特定できた後は、補正の工程に入ります。補正手法には「前処理」「モデル内処理」「後処理」の3段階があり、どれを選ぶべきかは、モデルの再学習が可能か、処理速度への影響は許容できるかといった、プロジェクトごとの現実的な制約に依存します。

プロジェクトの制約に応じた手法の推奨と実装

ここでは、現場の状況に合わせて最適な手法を選定させ、実装コードまで生成させるプロンプトを使用します。

【プロンプトテンプレート:補正アルゴリズム実装アシスタント】

## Role

あなたはPyTorch/TensorFlowに精通したAIエンジニア兼、AI倫理の実装スペシャリストです。

## Context

画像認識モデル(タスク: {{task_type: 分類/検出}})の開発において、以下の属性バイアスが確認されました。

- バイアス対象属性: {{sensitive_attribute}}

- 現状の問題: {{problem_description: 例: 特定の属性グループのFalse Negative率が高い}}

## Constraints

- フレームワーク: {{framework: PyTorch / TensorFlow}}

- モデル再学習: {{retrainable: 可能 / 不可能}}

- 推論レイテンシ制約: {{latency_constraint: 厳しい / 緩やか}}

## Instructions

1. 手法選定: 上記制約に基づき、最も効果的かつ実装可能なバイアス補正手法(例: Reweighting, Adversarial Debiasing, Threshold Optimizationなど)を1つ選定し、その理由を簡潔に述べてください。

2. コード生成: 選定した手法を実装するためのPythonコードスニペットを作成してください。

- 既存のDatasetクラスやTraining Loopに組み込みやすい関数またはクラスとして記述すること。

- コード内には、各処理が「なぜ公平性に寄与するか」を説明するコメントを必ず含めること。

## Output Example

## 推奨手法: Class-Balanced Loss (Reweighting)

理由: 再学習が可能であり、推論時のアーキテクチャ変更やレイテンシ増加を避けたいため、損失関数の調整が最適です。

## 実装コード

```python

import torch

import torch.nn as nn

class FairLoss(nn.Module):

def __init__(self, ...):

super().__init__()

# 初期化処理

def forward(self, inputs, targets, sensitive_attrs):

"""

sensitive_attrsに基づき、少数派グループの損失重みを動的に増加させる

"""

# 実装詳細...

### 実装のポイント:なぜコードに「意図」を含めるか

生成されたコードをそのままコピーして使用するのは推奨できません。プロンプト内で「なぜ公平性に寄与するかをコメントする」よう指示しているのは、コードレビューの際にチーム内での説明責任を果たし、保守性を高めるためです。

例えば、敵対的バイアス除去(Adversarial Debiasing)を選択した場合、モデルは「画像の特徴から性別などの属性情報を予測できないように」学習します。これは全体の精度低下を招く可能性があるため、コード上のコメントで「属性情報の漏洩を防ぐための処理」といった明確な説明があれば、チーム内での認識合わせがスムーズに進みます。

## Phase 3:補正効果を可視化し「説明責任」を果たすためのプロンプト

技術的な補正が完了しても、プロセスは終わりではありません。ビジネス側や倫理審査の担当者に対して、「どの程度公平になったのか」「それによって精度などのビジネス指標はどう変化したのか」を論理的かつ分かりやすく説明する必要があります。

### 公平性指標の比較とトレードオフ分析

【プロンプトテンプレート:倫理審査用・技術検証レポート作成】

```markdown

## Role

あなたは企業のAIガバナンス責任者に対し、技術的な検証結果を分かりやすく報告するシニアデータサイエンティストです。

## Input Data

補正前後の評価メトリクス:

[Before]

- Accuracy: {{acc_before}}

- Demographic Parity Difference: {{dp_diff_before}}

- Equalized Odds Difference: {{eo_diff_before}}

[After]

- Accuracy: {{acc_after}}

- Demographic Parity Difference: {{dp_diff_after}}

- Equalized Odds Difference: {{eo_diff_after}}

## Instructions

以下の構成で、倫理審査委員会向けの短い報告レポートを作成してください。

1. サマリー: 補正施策によって公平性がどの程度改善したか、一言で要約。

2. トレードオフ分析: 公平性の向上に伴い、全体の精度(Accuracy)にどのような影響があったか。その低下が許容範囲内であるかどうかの論拠。

3. 残存リスク: 依然として残っているバイアスの可能性と、運用時のモニタリング方針。

## Tone

客観的かつ、ビジネスリスクを考慮した信頼感のあるトーン。

このプロンプトを活用することで、専門的な数値データから、ビジネス上の判断に必要な分かりやすい言葉を導き出すことができます。特に「トレードオフ分析」は非常に重要です。完全な公平性を実現することは難しく、常に精度とのバランス調整が求められます。「精度はわずかに低下したが、公平性の指標は改善し、コンプライアンス基準を満たした」といった、現実的で誠実な説明をLLMに作成させましょう。

AI品質保証担当者が陥りやすいバイアス補正の落とし穴

ここまで、プロンプトを活用した効率化の手法について解説しましたが、最後に、LLMを導入しても人間が慎重に判断しなければならない重要な落とし穴について説明します。

「公平性」の定義不一致による手戻り

実務の現場で最も頻繁に発生するのは、プロジェクトメンバー間で「何をもって公平とするか」の定義がずれているケースです。

- 人口統計学的パリティ(Demographic Parity): 結果の割合を属性間で等しくする考え方です(例:採用AIで男女の合格率を同じにする)。

- 等価オッズ(Equalized Odds): 正解率や誤検知率を属性間で等しくする考え方です(例:顔認証で、どの人種でも同じくらいの確率で正しく認証される)。

これら2つの概念は、数学的に両立しないことが証明されています。LLMに指示を出す前に、プロジェクトとしてどちらの公平性を目指すのかを明確に決定する必要があります。この前提が曖昧なままでは、LLMが矛盾したコードやレポートを出力してしまうリスクがあります。

プロキシ変数によるバイアスのすり抜け

「学習データから性別の項目を削除したから問題ない」と考えるのは危険な誤解です。画像データの場合、服装、背景、髪型などが代理(プロキシ)変数となり、モデルが間接的に属性を学習してしまうことがあります。

Phase 1の分析プロンプトで「交差属性」を確認したのは、まさにこの現象を防ぐためです。単に属性のラベルを削除するのではなく、属性による性能差を継続的に監視する体制を構築することこそが、真の公平性を担保する現実的な解決策となります。

まとめ:倫理的AI開発を「負担」から「競争力」へ

画像認識AIにおけるバイアス対応は、一見すると開発のスピードを遅らせる負担の大きい作業に感じられるかもしれません。しかし、適切なプロンプトを用いてLLMをQAプロセスに組み込むことで、既存の業務フローに無理なく統合し、効率化を図ることが可能です。

- 検知: 隠れた不均衡を統計データから自動的に抽出します。

- 実装: 現場の制約条件に合わせた最適な補正コードを生成します。

- 報告: 精度と公平性のバランスを、専門外の方にも分かりやすく言語化します。

これらの工程を自動化することで、QA担当者は単なる数値の計算ではなく、リスクの総合的な判断という本質的な業務に集中できるようになります。倫理的に堅牢なAIモデルを構築することは、問題発生のリスクを未然に防ぐだけでなく、多様なユーザーに高品質なサービスを提供し、企業のビジネス成長を支援する強力な競争力となるはずです。

コメント