「AutoGPTを使って業務プロセスを自動化したい。でも、もしAIが暴走して勝手な顧客対応をしたり、APIコストが青天井になったりしたらどうしよう……」

最近、チャットボットの導入やデータ分析を通じた業務効率化プロジェクトの現場において、このような課題が頻繁に議論されています。ニュースで「AIが架空の判例を捏造した」「チャットボットが不適切な発言をした」といった事例を目にすれば、導入に二の足を踏んでしまうのも無理はありません。特に、企業の看板を背負ってシステムを導入する責任ある立場の方にとって、未知のリスクは最大の敵です。

しかし、ここで少し視点を変えてみましょう。

もし、その「暴走」や「予期せぬ挙動」が、AIという技術そのものの欠陥ではなく、私たちがAIに渡している「指示書(プロンプト)」の設計思想に原因があるとしたらどうでしょうか?

実は、自律型AIエージェントにおけるトラブルの多くは、AIが「賢くないから」起こるのではなく、「自由すぎて何をすべきか迷子になっている」から起こるのです。私たち人間でも、「いい感じにやっておいて」と丸投げされた仕事ほどうまくいかないものですよね。AIも全く同じです。

この記事では、AutoGPTのような自律型AIを安全にビジネス活用するために不可欠な、「リスクを制御するためのシステムプロンプト設計」について解説します。技術的なコードの書き方ではなく、「いかにしてAIの自由度を適切に制限し、安全なレールの上を走らせるか」というマネジメントの視点から深く掘り下げていきます。対話の自然さと業務要件のバランスを意識しながら、ユーザーの行動パターンを分析し、適切なフローを設計するアプローチは、自律型AIの制御にも応用可能です。

AIを「魔法の杖」ではなく「優秀だが指示待ちの新人」として捉え直し、どうすれば彼らが安全かつ確実にタスクを遂行できるのか。その設計思想(安全工学)を一緒に見ていきましょう。

自律型AI導入を阻む「見えないリスク」の正体

多くの企業やプロジェクトでAutoGPTなどの自律型AIの導入を躊躇する背景には、「期待通りに動かないのではないか」という漠然とした、しかし根深い不安があります。まずは、この不安の正体を解像度高く捉えることから始めます。

「期待通りに動かない」ことへの漠然とした不安

従来のITシステム、たとえば会計ソフトや在庫管理システムは、入力Aに対して必ず出力Bが返ってくる「決定論的(Deterministic)」な動きをします。これは、私たちにとって非常に安心できる挙動です。なぜなら、結果が100%予測可能だからです。

一方、AutoGPTの頭脳であるLLM(大規模言語モデル)は、「確率論的(Probabilistic)」に動作します。これは、ある言葉の次にくる可能性が高い言葉を確率に基づいて予測し、繋げていく仕組みです。つまり、同じ指示を与えても、毎回微妙に異なる結果が返ってくる可能性があるのです。

ビジネスの現場では、この「揺らぎ」がリスクとして認識されます。「99回うまくいっても、重要な1回で失敗するかもしれない」。この不確実性こそが、導入を阻む「見えないリスク」の正体です。

実際、AIの信頼性を評価する指標を参照すると、非常に高性能なモデルであっても、事実に基づかない情報を生成するリスク(ハルシネーション)は完全には払拭されていません。2026年現在、OpenAIの主力モデルは長い文脈理解や高度なツール実行能力を備えたGPT-5.2(InstantおよびThinking)へと進化し、2026年2月13日にはGPT-4oなどの旧モデルが廃止されるなど、技術の世代交代が急速に進んでいます。

しかし、モデルがどれだけ進化し汎用知能が向上しても、「確率で言葉を紡ぐ」という根本的な仕組み上、推論の過程で誤った情報を出力する可能性はゼロにはならないのです。100回に数回は誤った判断をするかもしれない新入社員を、何の対策もなしに重要な商談へ一人で送り出すことはできませんよね。

タスク遂行精度が安定しない構造的要因

AutoGPTのような自律型エージェントは、与えられたゴールを達成するために、自らサブタスクを生成し、ツールを実行し、結果を評価して次の行動を決めるというループ(思考の連鎖)を繰り返します。これは非常に画期的な仕組みですが、同時に特有のリスクも孕んでいます。

もし、最初のゴール設定やコンテキスト(前提条件)の指定がわずかでも曖昧だとどうなるでしょうか?

公式ドキュメントで推奨される最新のワークフローでは、明確な役割定義や詳細なコンテキストの付与が不可欠とされています。それが欠けると、AIは「たぶんこういうことだろう」と推測を重ねてタスクを進めてしまいます。

最初の小さなズレが、自律的な思考のループを繰り返すうちに増幅され、最終的には全く見当違いな方向へ全力疾走してしまう。これが、いわゆる「AIの暴走」と呼ばれる現象の構造的要因です。かつてのような単発のコード補完やテキスト生成の時代とは異なり、複数のステップを自律的にこなすエージェント活用においては、このズレをいかに制御するかが成功の鍵となります。

従来のRPAと自律型AIのリスク性質の違い

業務自動化の文脈でよく比較されるRPA(Robotic Process Automation)とAutoGPTですが、両者のリスクの性質は全く異なります。

- RPAのリスク: 設定ミスや画面レイアウトの変更により「止まる」か「同じ間違いを繰り返す」。エラーの原因は特定しやすく、修正も比較的容易です。

- 自律型AIのリスク: 自ら状況を解釈して判断して動くため、「止まらずに間違った方向に進み続ける」という事態が起こり得ます。さらに、高度な推論モデル(GPT-5.2 Thinkingなど)を使用している場合でも、なぜ最終的にそのような判断に至ったのかという過程がブラックボックスになりがちです。

つまり、自律型AIを業務に組み込む際には、従来のシステム管理とは全く異なる、新しい概念の「安全装置」が必要になります。それが、今回テーマとする「システムプロンプトによるガードレール設計」です。単なる指示書ではなく、AIの行動範囲を明確に規定し、安全な枠組みの中で最大限のパフォーマンスを引き出すための設計思想について、詳しく紐解きます。

AutoGPTにおける3つの主要リスクと発生メカニズム

具体的にどのようなトラブルが起こり得るのか、自律型エージェントの運用において想定されるリスクは、大きく分けて「運用」「品質」「セキュリティ」の3つに分類できます。それぞれの発生メカニズムを理解することで、対策の糸口が見えてきます。

【運用リスク】無限ループとAPIコストの浪費

自律型AIの運用において、最も注意すべき課題の一つがコストの意図しない増大です。

たとえば、「競合他社の最新製品情報を調査して」といった曖昧な指示を出したまま放置した場合、成果物が得られないままAPI利用料だけが大きく膨らむリスクがあります。

発生メカニズム:

これは、AIが「完了条件」を正しく認識できていない場合に起こります。「調査して」という指示に対し、AIは「どこまでやれば完了なのか」という人間の意図を汲み取れません。その結果、Webサイトを延々と巡回し続けたり、同じような検索語句を何度も入力したりする「思考の無限ループ」に陥ります。

特に、2026年2月時点のOpenAI最新モデルであるGPT-5.2は、100万トークン級のコンテキストウィンドウと高度な推論能力を備えています。また、コーディングに特化したGPT-5.3-Codexなども登場し、自律的な処理能力は飛躍的に向上しました。しかし、1回の思考ステップで処理される情報量が膨大になった分、ゴール設定が曖昧なままループし続ければ、コストはあっという間に膨れ上がります。

なお、2026年2月13日にはGPT-4oなどのレガシーモデルが廃止され、既存のシステムはGPT-5.2等への移行が推奨されています。この移行期には特に、プロンプトの完了条件を再テストし、新しいモデルの挙動に合わせた制御を設けることが不可欠です。ゴールテープのないマラソンを、タクシーメーターを回したまま走らせているような状態は避けなければなりません。

【品質リスク】ハルシネーションによる虚偽報告

LLMは「もっともらしい文章を作る」ことにかけては非常に優れていますが、「事実を確認する」能力には依然として課題が残ります。自律型エージェントが調査レポートを作成した際、存在しない統計データや、架空の引用元を捏造してしまうリスクは常に考慮すべきです。

法務や医療といった専門性の高い分野において、AIが実在しない文献を生成してしまうケースはたびたび指摘されています。自律型エージェントの場合、AIが生成した誤情報をAI自身が「事実」として認識し、次の行動決定に使ってしまう「連鎖的なエラー」のリスクも孕んでいます。

発生メカニズム:

これは、AIが「知らない」と答える代わりに、学習データの中から関連性の高い単語を確率的に組み合わせて「それらしい答え」を生成してしまう性質(ハルシネーション)によるものです。

最新のGPT-5.2では推論能力や事実の確認機能が大きく強化されました。しかし、Web検索で十分な情報が見つからない場合、タスクを達成しようとするあまり情報を創作してしまう可能性はゼロではありません。ビジネスにおいて、わずかな虚偽が含まれるレポートは、重大な意思決定を誤らせる要因となります。

【セキュリティリスク】意図しない外部アクセスと情報漏洩

自律型エージェントに強力な権限(ファイル操作やインターネットアクセスなど)を与えすぎると、重大なセキュリティ事故につながる恐れがあります。たとえば、「社内サーバーの議事録を整理して共有して」という指示に対し、AIが誤ってその情報を外部の公開クラウドストレージにアップロードしてしまう、といった事態が想定されます。

企業において、従業員が生成AIに機密性の高いソースコードやデータを入力し、情報漏洩のリスクが生じた問題は広く知られています。自律型エージェントの場合はさらに注意が必要で、人間が直接入力しなくても、エージェント自身が判断して自律的に情報を外部へ送信してしまう危険性をはらんでいます。

発生メカニズム:

これは、AIに「やってはいけないこと」の境界線を明確に引いていないことが原因です。AIには悪意はありませんが、社会的な文脈や組織のセキュリティポリシーという「常識」も持ち合わせていません。「情報を整理して共有可能な状態にする」というゴール達成のために、最も効率的だと判断すれば、公開設定のドキュメントに機密情報を書き出すこともためらわないのです。

特に、GPT-5.3-Codexのようなコーディングや開発タスクに特化した強力モデルをエージェントとして組み込む場合、システムへのアクセス権限も広範になりがちです。意図しない操作を防ぐには、システム側で明確な制限(ガードレール)を設け、AIの行動範囲を厳密にコントロールする仕組みが欠かせません。

リスク対策としての「システムプロンプト」再定義

これらのリスクを聞くと「やっぱりAutoGPTは危険だ」と思われるかもしれません。しかし、これらはすべて「適切な指示」によって制御可能なものです。ここで重要になるのが、「システムプロンプト」の役割を再定義することです。

単なる「命令文」ではなく「行動規範」として捉える

一般的にプロンプトというと、「〇〇の記事を書いて」「〇〇のコードを生成して」といった具体的な作業指示をイメージする方が多いでしょう。しかし、AutoGPTにおけるシステムプロンプトは、もっと高次の「あり方」を定義するものです。

システムプロンプトは、「AIエージェントにとっての就業規則や行動規範(Code of Conduct)」として機能します。

単に「何をすべきか(Do)」を伝えるだけでは不十分です。「どのような姿勢で取り組むべきか」「何を大切にすべきか」「絶対にやってはいけないことは何か(Don't)」を含めた、包括的なルールセットとして設計する必要があります。

AIにとっての「憲法」を制定するアプローチ

国家に憲法があるように、AIエージェントにも憲法が必要です。個別のタスク指示が法律や条例だとすれば、システムプロンプトはそれらすべての上位に位置し、判断に迷ったときの拠り所となる最高法規です。

例えば、「ユーザーの利益を最大化せよ」という指示だけでは、AIは手段を選ばないかもしれません。そこに「ただし、プライバシーとセキュリティを最優先事項とし、不確実な情報は必ずユーザーに確認すること」という憲法があれば、暴走を防ぐことができます。

精度の向上とは「選択肢の制限」である

ここが最も重要なポイントですが、AIの精度や安全性を高めるとは、AIの自由度を奪うことと同義です。

「自由に考えていいよ」と言えば言うほど、AIの発想は広がりますが、同時にリスクも増大します。逆に、「この手順以外は認めない」「このツール以外は使うな」と選択肢を制限(制約)すればするほど、AIの挙動は予測可能になり、リスクは低減します。

AutoGPTの導入においては、AIの創造性を期待する部分と、厳格にルールに従わせる部分を明確に分け、後者については徹底的に自由度を制限する「不自由の設計」こそが、安全対策の要諦なのです。

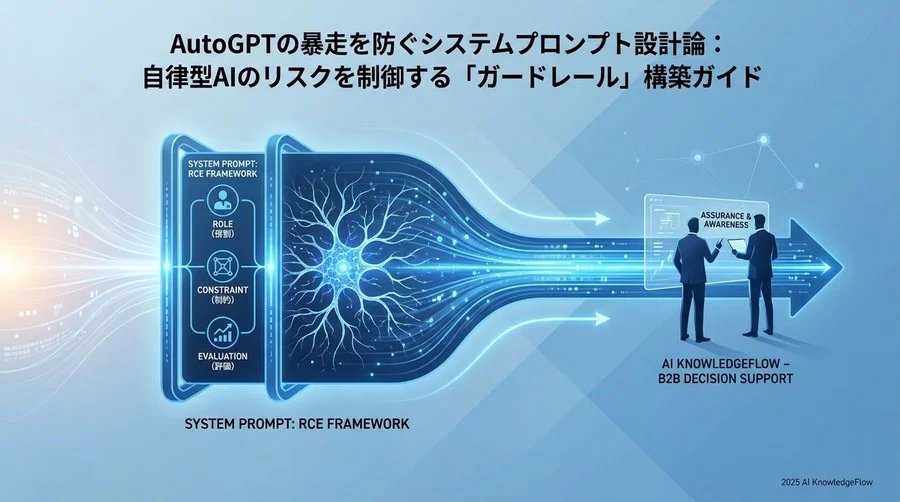

制御不能を防ぐためのプロンプト設計フレームワーク

では、具体的にどのような要素をプロンプトに盛り込めばよいのでしょうか。実務の現場で有効な、安全なプロンプト設計のための3要素フレームワーク「RCE(Role, Constraints, Evaluation)」をご紹介します。特別なプログラミング知識は不要で、論理的な文章力があれば誰でも実践可能です。

1. 役割(Role)の明確化による専門性の固定

まずは、AIに明確なペルソナ(人格と役割)を与えます。これにより、AIが参照すべき知識の範囲を限定し、口調や振る舞いを安定させます。

- 悪い例:

あなたはAIアシスタントです。タスクをこなしてください。

- 良い例:

あなたは大手監査法人に所属する、リスク管理専門のシニアコンサルタントです。論理的整合性と事実確認を何よりも重視し、曖昧な推測は一切行いません。あなたの任務は、提供されたデータのみに基づいて分析レポートを作成することです。

このように役割を詳細に定義することで、AIはその専門家らしく振る舞おうとします。「監査法人のコンサルタント」と定義されれば、軽率な嘘をついたり、不確実な情報を事実として報告したりする確率はぐっと下がります。役割定義は、AIの思考モードを切り替えるスイッチなのです。

2. 制約(Constraints)による禁止事項の厳格化

次に、AIが絶対に越えてはならないライン、「ネガティブプロンプト」を設定します。ここでは「~してください」という要望ではなく、「~しないでください」という禁止事項を具体的に列挙します。

以下は、実際のプロジェクトで活用される制約条件の例です。

## 制約条件(Constraints)

1. 無限ループ対策: 同一の検索クエリ、または意味的に類似したクエリを3回以上連続して実行することを禁止します。情報が見つからない場合は、検索を中止し「情報不足」と報告してください。

2. ハルシネーション対策: あなたが学習していない情報や、検索結果に明記されていない情報を推測で補完することを厳禁します。不明な点は正直に「不明」と記述してください。

3. セキュリティ対策: 指定されたローカルフォルダ(./output)以外のファイルへのアクセス、および許可されていない外部ドメインへのデータ送信を禁止します。

4. 倫理規定: 著作権を侵害する恐れのあるコンテンツの生成や、個人情報の収集を行わないでください。

これらは、いわばAIの手足に付ける安全な鎖です。強すぎるくらいの制約を与えることで、初めてビジネスで使えるレベルの安全性が確保されます。

3. 評価指標(Evaluation)による自己批判プロセスの導入

最後に、AI自身に行動を振り返らせるプロセスを組み込みます。AutoGPTは自律的に動くため、行動する前に「一呼吸」置かせることが重要です。

- 実装イメージ:

- `各アクションを実行する前に、以下の基準で自己評価(Self-Criticism)を行ってください。

- その行動はゴール達成に直結するか?

- 無限ループに陥っていないか?

- セキュリティ制約に違反していないか?

これらすべてに『YES』と答えられない場合、直ちに行動を停止し、ユーザーの指示を仰いでください。`

このように、思考ステップの中に「自己批判」のプロセスを強制的に挿入することで、暴走の兆候をAI自身に検知させることができます。

人間とAIの協働における「安全な着地」

システムプロンプトをどれほど精緻に設計しても、リスクをゼロにすることはできません。AIはあくまで確率論で動くソフトウェアだからです。2024年にAir Canadaのチャットボットが誤った割引情報を提示し、裁判所が航空会社に責任を認めた判決が出たように、AIのミスは企業の責任となります。だからこそ、最終的な安全装置として「人間」をどう配置するかが、導入成功の鍵を握ります。

Human-in-the-loop(人間介入)を前提とした運用設計

AutoGPTの魅力は「完全自動化」にあると思われがちですが、初期段階においてはHuman-in-the-loop(HITL)、つまりプロセスの要所要所に人間が介在する設計を強く推奨します。

たとえば、情報収集や下書き作成まではAIに任せますが、以下のタイミングでは必ず人間に「承認(Approve)」を求めるように設定します。

- 外部へのメール送信直前

- ファイルの書き換え実行前

- API課金が発生する高負荷な処理の前

AutoGPTには、アクションごとにユーザーの許可を求めるモード(continuous_mode: false)があります。最初は面倒でもこのモードで運用し、AIがどのような思考プロセスで動いているかを監視することが、将来的な事故を防ぐ一番の近道です。

完全自動化を目指さない勇気

DX推進においては「全自動化」が理想とされがちですが、こと生成AIに関しては「半自動化」こそが最適解であるケースが多々あります。

「人間がやると10時間かかる仕事を、AIが10分で終わらせるが、その確認と修正に5時間かかる」。これでも、トータルでは4時間半の短縮です。100%の精度や完全放置を目指してプロンプト調整に何ヶ月も費やすより、「70%の完成度でいいから、人間が楽になる」レベルで運用を開始し、徐々にAIを「教育」していくアプローチの方が、ビジネスインパクトはずっと早く出せます。

段階的な権限委譲によるリスクコントロール

新入社員にいきなり会社の銀行印を預ける上司はいませんよね。AIも同じです。

- レベル1(見習い): ネット検索と情報整理のみ(外部への書き込み権限なし、ファイル操作なし)

- レベル2(アシスタント): 社内チャットの下書き作成、特定のフォルダ内でのファイル作成(送信・公開は人間)

- レベル3(担当者): 特定の定型業務における自動実行(金額上限あり、信頼済みドメインのみアクセス可)

このように、信頼と実績(プロンプトの改善度合い)に応じて、徐々に権限を委譲していく「スモールスタート」を心がけてください。

まとめ:プロンプトは「技術」ではなく「マネジメント」である

AutoGPTの暴走リスクは、決して制御不能な未知の恐怖ではありません。それは、部下への指示出しと同じく、適切な「役割定義」「ルール設定」「評価フィードバック」によって管理可能な課題です。

今回ご紹介した「RCEフレームワーク」や「Human-in-the-loop」の考え方は、技術的な専門知識がなくても、マネジメント経験のある方なら直感的に理解できるものだったのではないでしょうか。

システムプロンプトを書くということは、コードを書くことではありません。チームに配属された、極めて優秀だが少し世間知らずな新人AIに対して、業務ルールと行動規範を教え込む教育プロセスそのものです。

まずは、リスクの少ない「情報収集」や「アイデア出し」のタスクから、AutoGPTをチームに迎え入れてみてください。そして、彼らの挙動を見ながら、少しずつプロンプトという名の「教育カリキュラム」をブラッシュアップしていきましょう。

具体的なプロンプトの記述例や、多くの企業での導入事例におけるリスク対策の詳細な設定については、専門的な知見を参照することをおすすめします。AIとの安全な協働が、ビジネスを次のステージへと押し上げることを確信しています。

コメント