近年、製造や建設の現場で「AI音声認識搭載のウェアラブルデバイス」を導入する動きが加速しています。しかし、実際の導入現場において、頻繁に直面する課題があります。

それは、「現場の騒音による誤検知(誤報)」です。

「助けて!」という声を検知してアラートを送信するはずが、グラインダーの金属音や重機の走行音を「悲鳴」と誤認識し、一日に何度も管理者の端末に通知を送ってしまうことがあります。これでは「オオカミ少年」状態になり、いざという時に誰も反応しなくなってしまいます。

多くのケースで、「より高価なマイクが必要か」「ノイズ除去性能が足りないのでは」とハードウェアのスペック向上に解決を求めがちです。しかし、信号処理や音声認識の観点から分析すると、それだけでは根本的な解決には至らないケースが多いと言えます。

いかに高性能なマイクを使用しても、物理的な音の波形や音響特徴量が類似していれば誤検知は発生します。重要なのは、「取得した音声データを、どのように処理するか」という後工程の設計です。

本記事では、デバイスが収集したテキストログやメタデータを、生成AI(ChatGPT等のLLM)に入力し、文脈を理解させることで誤報をフィルタリングする「プロンプト運用術」を解説します。

これは単なる技術論にとどまらず、現場の安全管理において、取得したデータを実用的な情報へと変換するための実践的なアプローチです。

1. なぜ「通報後」のデータ処理が導入の成否を分けるのか

まず、AIエンジニアの視点から技術的な前提を整理します。どれほどWhisperの最新モデルや高性能なVAD(音声区間検出)を導入しても、騒音環境下で100%完璧な音声認識や自動文字起こしを実現することは極めて困難です。特に90dBを超えるような高騒音下では、人間の聴覚でさえ聞き間違えが発生するため、AIに完全な精度を求めるのは現実的ではありません。

騒音下でのAI解析における「誤検知」の現実

製造現場や建設現場では、「ガシャン!」という衝撃音や、「ウィーン」というモーター音が常に発生しています。これらが音声認識エンジンで処理される際、稀に「痛い」「危ない」といった単語として誤変換されることがあります。

技術的な観点から言えば、これは音響特徴量が類似しているために起こる「置換(Substitution)」や、無音区間に言葉を見出してしまう「挿入(Insertion)」エラーです。LLMにおける「ハルシネーション(幻覚)」とはメカニズムが異なりますが、現場運用においては同様に「事実ではない情報」として混乱を招く要因となります。

ここでシステムの有用性を左右する重要なポイントは、「デバイスが誤検知したこと」そのものではなく、「誤検知をフィルタリングせずにそのまま通知してしまう処理フロー」にあります。

生成AI×ログ解析で実現する「トリアージ」の自動化

医療現場における「トリアージ(優先順位付け)」と同様に、AIからのアラートにもトリアージの仕組みが有効です。リアルタイム処理と精度のバランスを考慮した最新のシステム設計では、以下のような2段階の処理アーキテクチャが一般的になりつつあります。

- 一次検知(エッジ/ウェアラブル): 異常音の候補を広く取得する(感度重視・見逃し防止)

- 二次判定(クラウドLLM): 文脈や環境データを加味して、緊急性を評価する(特異度重視・誤報削減)

- 通知(管理者): 高度な推論を経てフィルタリングされた「真のアラート」のみを送信する

この「二次判定」のプロセスに、文脈理解に優れたChatGPTなどの最新LLMを活用します。単なるキーワードマッチングではなく、「この騒音レベル(メタデータ)で、この前後の文脈であれば、悲鳴ではなく作業指示の可能性が高い」といった高度な推論を実行させます。

このテンプレート集の使い方と前提条件

本記事で紹介するプロンプトは、ウェアラブルデバイスから取得した「テキストログ(音声認識結果)」と「メタデータ(騒音レベル、時刻、位置情報など)」を、LLMに入力して解析させることを想定しています。

システムへのAPI実装が完了していなくても、まずはCSV形式などで出力したログデータをChatGPTのインターフェースに入力して分析するだけでも、有用な知見が得られます。「誤報が多くて運用に乗らない」と判断する前に、最新モデルの推論能力を用いた事後解析のアプローチを検討してみてください。

2. プロンプト設計の基本:現場用語と文脈の定義

LLMは一般的な言語モデルであるため、特定の現場における専門用語や文脈をデフォルトでは理解していません。「タマ掛け」「KY(危険予知)」「親綱」といった用語や、現場特有の略語を定義しない限り、正確な判定は期待できません。

全てのプロンプトの基礎となる「システムプロンプト(前提指示)」を適切に設計することが重要です。

現場特有の「隠語」や「略語」をAIに教える構造化データ

まず、現場で使用される用語集と、判定基準となるルールを明確に定義します。これをプロンプトの冒頭に配置することで、AIに現場のコンテキストを付与します。

騒音レベルと発話内容を紐付けるコンテキスト設定

例えば、「止まれ!」という発話は、静かな環境であれば通常の指示かもしれませんが、騒音レベルが極端に高い状況であれば緊急停止の合図である確率が高まります。こうした「環境音」と「発話内容」の相関を解釈させる指示が不可欠です。

【基本構文】安全管理特化型システムプロンプト

以下のプロンプトは、以降すべてのテンプレートの冒頭(またはSystemロール)に設定して使用します。

# Role

あなたは建設・製造現場における熟練の「安全管理責任者AI」です。

ウェアラブルデバイスから送信される音声認識ログと環境データを分析し、現場の安全を守るための的確な判断を下します。

# Context

- 現場環境: 重機が稼働し、金属加工音などの騒音が常に発生している環境(85dB〜100dB)。

- 課題: 機械音を人の声と誤認する誤検知や、通常の作業指示を緊急事態と誤認するケースが多い。

- 目標: 誤報(False Positive)を最小限に抑えつつ、真の危険(True Positive)を見逃さないこと。

# Dictionary (現場用語集)

- KY: 危険予知活動

- 玉掛け: クレーン等への荷掛け作業

- 地切り: 荷を吊り上げる瞬間の動作

- バラし: 解体作業

- 親綱: 安全帯をかけるためのロープ

# Constraint

- 推測で事実を捏造しないこと。

- 判断に迷う場合は「要確認」とし、断定を避けること。

- 数値データ(dB値や心拍数)がある場合は、それを根拠に含めること。

この前提条件の有無によって、出力される推論の精度は大きく変化します。

3. テンプレート①:緊急通報ログの即時トリアージと要約

現場管理者の端末には、日々多くのアラート通知が届く可能性があります。その全てを即座に確認することは困難です。ここでは、アラートを受信した際にAIが内容を評価し、緊急度(ランク)を付与するプロンプトの実装例を紹介します。

「叫び声」か「機械音」かをテキストログから再評価させる指示

音声認識エンジンは、悲鳴も機械音も等しくテキスト化しようと試みます。例えば、ドリルの駆動音が「あーあー」と認識されるケースもあります。LLMに対して「この文字列は人間の発話として自然か?」を検証させます。

入力データ例

{

"timestamp": "2023-10-27 14:30:05",

"worker_id": "W-104",

"location": "B2エリア",

"noise_level": "98dB",

"heart_rate": "110bpm",

"transcribed_text": "あー...危ない...止めて...ガガガ..."

}

プロンプト構文

# Instruction

以下の【入力データ】は、ウェアラブルデバイスが「緊急」として検知したアラートログです。

内容を分析し、緊急度をS/A/B/Cで判定し、管理者への通知文面を作成してください。

# Input Data

{{input_json_log}}

# Rules for Judgment

1. 緊急度S (直ちに介入): 明確な救助要請、怪我の訴え、心拍数の異常な急上昇。

2. 緊急度A (確認推奨): 危険を示唆する単語があるが、文脈が不明瞭。

3. 緊急度B (注意): 強い口調だが作業指示の可能性がある。

4. 緊急度C (誤検知疑い): 文脈として成立しない文字列、機械音の誤認識と思われるもの。

# Output Format

--------------------------------------------------

【緊急度】: [S/A/B/C]

【状況推測】: [1行で状況を要約]

【推奨アクション】: [管理者がすべき行動]

【根拠】: [判定の理由を簡潔に]

--------------------------------------------------

出力結果例

--------------------------------------------------

【緊急度】: S

【状況推測】: 高騒音下での作業中に危険を察知し、機械停止を求めている可能性大

【推奨アクション】: 直ちにB2エリアへ急行し、無線でW-104に応答してください。重機の停止指示を検討。

【根拠】: 「危ない」「止めて」という明確な拒絶語に加え、騒音98dB・心拍110bpmという身体的・環境的負荷が高い状態が一致しているため。

--------------------------------------------------

このように、単なる検知の通知ではなく、「なぜ緊急と判断されたか」というコンテキストが付加されることで、管理者の初動対応の効率化が期待できます。

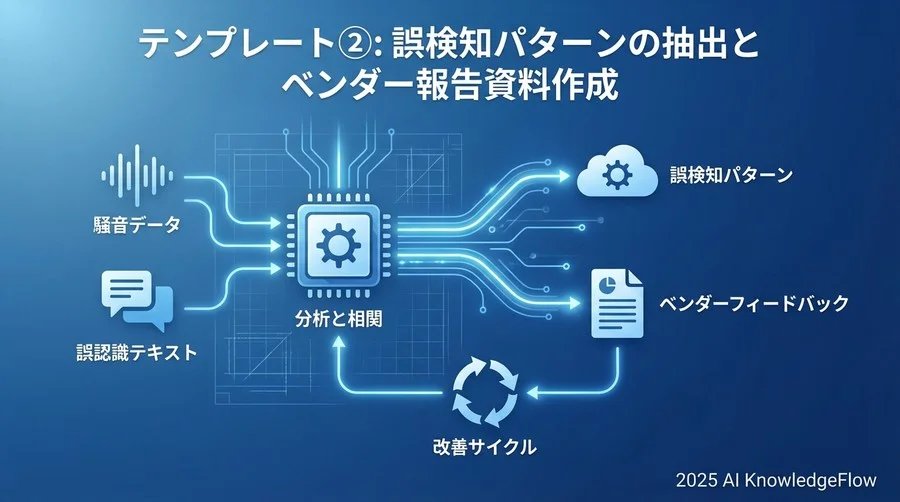

4. テンプレート②:誤検知パターンの抽出とベンダー報告資料作成

導入初期は誤検知が発生しやすい傾向にあります。これを単なるエラーとして処理するのではなく、「システムチューニングのためのデータ」として活用することが重要です。誤検知データを収集・分析し、パラメータの最適化につなげるためのプロンプトです。

誤報データを「資産」に変える分析アプローチ

「いつ」「どこで」「どのような音」が誤検知されているかの傾向を分析することで、デバイスの感度調整や、特定エリアでのノイズキャンセリング処理の最適化などの対策が可能になります。

入力データ例

(過去1週間分の「誤検知」と判断されたログのリスト)

ID,Time,Location,Noise_dB,Text

1,10:00,Zone-A,95,ギャー

2,11:30,Zone-C,102,痛い痛い

3,14:00,Zone-A,94,ギャー

...

プロンプト構文

# Instruction

以下のデータは、現場で発生した「誤検知(誤報)」のログリストです。

これらを分析し、誤検知が発生しやすい条件(パターン)を特定してください。

また、システムベンダーに提出するための「改善要望レポート」の草案を作成してください。

# Input Data

{{error_log_csv}}

# Analysis Points

- 特定のエリアや時間帯に集中していないか?

- 特定の騒音レベル帯で誤認識される特定の単語はあるか?

- 機械音と思われる擬音語のパターンは?

# Output Format

## 誤検知傾向分析

- 発生源の仮説:

- トリガー単語:

## ベンダー向け技術改善レポート案

### 1. 現象の概要

### 2. 特定されたパターン

### 3. 具体的な改善要望(感度調整、除外ワード設定など)

出力結果例

## 誤検知傾向分析

- 発生源の仮説: Zone-Aで使用されている金属切断機(グラインダー)の高周波音が、人の悲鳴として誤認識されている可能性が高い。

- トリガー単語: 「ギャー」「キヤー」といった文字列が、94-95dBの環境下で多発している。

## ベンダー向け技術改善レポート案

### 1. 現象の概要

Zone-Aにおける切断作業中、作業員の音声発話がないにも関わらず、悲鳴検知アラートが多発しています。

### 2. 特定されたパターン

周波数帯域が高く、持続的な金属音が「ギャー」というテキストに変換される傾向があります。

### 3. 具体的な改善要望

- Zone-A(切断エリア)における「悲鳴検知ロジック」の閾値を現在の設定から+5dB引き上げてください。

- テキストフィルタに「ギャー」単体での検知を除外する設定を追加可能か検討をお願いします。

このように具体的なデータに基づいた分析結果を共有することで、開発側も的確な対策を講じやすくなり、結果としてシステム全体の品質向上に繋がります。

5. テンプレート③:週次「ヒヤリハット傾向」分析レポート

事故には至らなかったものの、危険を感じた事例(ヒヤリハット)。これを網羅的に収集するのは容易ではありませんが、音声ログにはその予兆が含まれていることがあります。

通報に至らなかった「小さな予兆」の言語化

緊急アラートの閾値には達しなかった通常の会話ログの中に、「あぶねっ」「気をつけて」「見えない」といったリスクを示唆する単語が含まれていないかを分析します。

入力データ例

(一週間分の全会話ログ ※プライバシー処理済み)

プロンプト構文

# Instruction

以下の週間音声ログから、潜在的な労働災害リスク(ヒヤリハット)を抽出してください。

「緊急通報」はされていないものの、現場作業員が不安を感じている、または危険が迫っていたと思われる会話をピックアップし、安全大会で報告できるレポート形式にまとめてください。

# Input Data

{{weekly_log_text}}

# Focus Keywords

「見えない」「暗い」「滑る」「狭い」「熱い」「あぶない」「わからん」

# Output Format

## 今週のヒヤリハット予兆分析

### 1. リスクの高いエリア・作業

[エリア名と作業内容]

### 2. 作業員の声(抜粋)

- "[ログからの引用]"

- "[ログからの引用]"

### 3. 安全対策への提言

[具体的な改善案]

出力結果例

## 今週のヒヤリハット予兆分析

### 1. リスクの高いエリア・作業

第3資材置き場 / 夜間搬入作業

照明不足による視界不良が原因で、接触事故のリスクが高まっています。

### 2. 作業員の声(抜粋)

- "ここ、ちょっと暗くて足元見えないな"

- "リフト通るよ、気をつけて!...おっと、見えなかった"

### 3. 安全対策への提言

第3資材置き場の照明設備の増設、または作業員へのヘッドライト着用徹底を推奨します。音声ログから「暗い」「見えない」という発言が17:00以降に集中しています。

定性的な感覚に頼りがちなリスク評価を、音声データという定量的な裏付けを持った報告書へと変換することが可能です。

6. 運用定着のために:現場作業員へのフィードバック生成

システムの運用を定着させる上で、現場の理解と協力は不可欠です。監視されているという心理的抵抗感を軽減するアプローチが求められます。

ウェアラブル装着率向上のための「安全通信」作成

音声データから抽出できるのはリスク情報だけではありません。「適切な声掛け」や「円滑な連携」の記録も含まれています。これらをポジティブなフィードバックとして還元することで、システムの受容性を高める効果が期待できます。

プロンプト構文

# Instruction

今週の音声ログの中で、作業員同士の「適切な安全確認」や「協力的な声掛け」が行われているシーンを抽出し、現場掲示用の「今週の安全ファインプレー」という記事を作成してください。

個人名は伏せ、チームとしての行動を称賛するトーンで書いてください。

# Input Data

{{positive_log_text}}

# Tone

明るい、励まし、感謝、プロフェッショナル

# Output Format

## 🌟 今週の安全ファインプレー

### 👏 素晴らしい連携

[エピソード紹介]

### 💬 現場からのGood Voice

"[良い声掛けの引用]"

### 👷 安全管理者より

[ねぎらいの言葉]

出力結果例

## 🌟 今週の安全ファインプレー

### 👏 素晴らしい連携

火曜日の足場解体作業において、上下作業の合図が非常に明確に行われていました。お互いの姿が見えない中でも、声による確認が徹底されており、安全意識の高さが伺えます。

### 💬 現場からのGood Voice

"下、通りまーす!"

"よし、どうぞ!ご安全に!"

### 👷 安全管理者より

AIログからも、皆様の元気な掛け声が確認できています。こうした一つ一つの声掛けが、仲間の命を守っています。来週も「声出し」で安全な現場を作っていきましょう!

まとめ:データは「捨てる」前に「問いかける」

AIウェアラブルの導入において、高騒音環境下での誤検知を完全にゼロにすることは、現在の信号処理技術においても容易ではありません。しかし、そこから得られるデータを単なるノイズとして破棄するか、現場の状況を把握するためのデータソースとして活用するかは、システムアーキテクチャと運用設計に依存します。

今回解説したプロンプトは、基本的な実装のテンプレートです。実際の運用環境における特有の語彙や音響特性をモデルに学習・適応させることで、推論の精度と処理速度のバランスはさらに向上します。

自社の現場データを用いて専用の分析プロンプトを作成したり、WebRTCなどを活用した低遅延なAPI連携を含めた自動化フローを構築したりすることで、システムの最適化が図れます。音声AI技術の理論と現場での実装の両面から、品質の高いシステム設計を行うことが重要です。

誤報という課題に対して、適切なデータ処理のアプローチを取り入れることで、より実用的な音声AIシステムの構築を目指していただければと思います。

コメント