AIエージェントや最新AIモデルの研究・開発の最前線では、毎日のようにarXiv(アーカイブ)に投稿される膨大な論文の山に直面します。「この新しいアルゴリズムは本当に画期的なのか?」「実験条件に偏りはないか?」。これらを全て精読し、検証するには時間がいくらあっても足りません。

皆さんも、業務で論文や技術レポートを読む際、同じような課題を感じていないでしょうか。

「統計の専門家ではないので、p値や信頼区間の解釈に自信がない」

「著者の主張が、実際のデータに即しているのか判断が難しい」

「とにかく読むべき量が多すぎて、重要な欠陥を見落としていないか不安」

もし、AIを単なる「要約ツール」として使っているなら、それは非常にもったいないことです。現在の生成AI、特にコンテキストウィンドウ(扱える情報量)が拡張されたモデルは、論文の内容を要約するだけでなく、論理の整合性を検証し、統計的な疑義を呈する「批判的吟味(Critical Appraisal)」のパートナーとして極めて優秀だからです。

今回は、実務の現場で活用されている「AIを用いた論文検証パイプライン」を、エンジニアリングと経営の視点を交えて解説します。これは、単に時間を短縮するだけでなく、人間の認知バイアスを補完し、より客観的で科学的な評価を下すための実践的なアプローチです。まずは手を動かし、プロトタイプとして試してみることをお勧めします。

このチュートリアルのゴール:AIを「読む」から「検証する」パートナーへ

まず、マインドセットを変えるところから始めましょう。AIに対する期待値を「時短(Efficiency)」から「品質担保(Quality Assurance)」へとシフトさせます。

要約だけでは見抜けない「研究の落とし穴」とは

一般的な要約プロンプト(例:「この論文を要約して」)は、著者が書いたアブストラクト(要旨)を再構成するだけのことが多いです。しかし、論文には「著者自身のバイアス」が含まれている可能性があります。

- チェリーピッキング: 都合の良いデータだけを選択的に提示している。

- Overclaiming(勇み足): 結果の範囲を超えて、過度な一般化や因果関係を主張している。

- 交絡因子の無視: 結果に影響を与える他の変数を考慮していない。

これらは、著者の主張を鵜呑みにする「要約」では見抜けません。AIに対して「著者の主張を疑え」「データの不整合を探せ」という明確な指示(System Instruction)を与えることで初めて、AIは鋭い指摘を行うようになります。

批判的吟味(Critical Appraisal)をAIで効率化する意義

批判的吟味とは、論文の研究デザイン、実施方法、解析手法、結果の解釈などを体系的に評価し、そのエビデンスとしての価値を判断するプロセスです。本来、高度な専門知識と時間を要する作業ですが、AIを活用することで以下のようなメリットが生まれます。

- 統計リテラシーの補完: 複雑な統計モデルの前提条件や解釈について、AIが解説・指摘してくれる。

- 視点の多角化: 自分では気づかなかった論理的矛盾や、他分野の視点からの指摘を得られる。

- 構造化の自動化: PICO(対象・介入・比較・結果)などのフレームワークに合わせて情報を整理し、情報の欠損を可視化できる。

本記事で作成する「査読プロンプト」の全体像

ここでは、以下の5つのステップで検証パイプラインを構築します。

- 環境構築: 最適なモデル選びとテキスト前処理。

- 構造化: PICOフレームワークを用いた骨子の抽出。

- バイアス検知: 研究デザインに潜む統計的バイアスの特定。

- 論理検証: 結果と考察の乖離(Overclaiming)の検出。

- 統合評価: 人間による最終判断とレポート作成。

それでは、実際に手を動かしながら進めていきましょう。

Step 1: 準備と環境構築

高精度な検証を行うためには、道具選びと下準備が重要です。AIモデルの進化サイクルは非常に速く、使用するモデルの世代によって検証精度に大きな差が生じます。常に最新の技術スタックをアップデートし続けることが、ビジネスへの最短距離を描く鍵となります。

推奨されるAIモデルの選び方

論文の批判的吟味において、現在推奨されるのは Claude です。これまでのモデルと比較しても、以下の点で論理検証に適しています。

- 思考プロセスの制御: 最新の環境では「Adaptive Thinking(適応型思考)」のように、タスクの複雑度に応じて推論の深度を自動調整する機能が実装されています。これにより、複雑な論文の論理構造をより詳細に分析できます。

- 長文脈の理解とメモリ機能: 100万トークン級の長大なコンテキストウィンドウに対応し、上限に近づくと自動的にサマリーを生成する機能(Compaction機能)も備わっています。論文全体(メソッド、結果、補足資料)に加え、関連するコンテキストを保持する能力が向上しており、離れた文脈にある矛盾を検知する精度が格段に高まりました。

- ハルシネーションの抑制: 検証可能な推論能力が強化され、記述がないことに対して「記述なし」と判断する能力が高く、事実に基づかない回答をするリスクが低減されています。

一方、ChatGPTも論文検証において非常に優秀な選択肢です。100万トークン級の文脈理解に加え、高度な推論機能、そしてマルチモーダル(テキスト、画像、PDFの同時処理)な検証が必要な場合に適しています。データ分析機能を用いて図表データを直接解析させる際にも強力なツールとなります。

【重要:モデルの世代交代と移行手順について】

AIモデルのライフサイクルは短命です。例えばOpenAIの環境では、GPT-4oやGPT-4.1などのレガシーモデルは廃止され、GPT-5.2が新たな標準モデルへ移行するという大規模なアップデートが行われました。また、データ処理や開発に特化したGPT-5.3-Codexのようなモデルも追加されています。

古いモデルに依存したプロンプトやシステム連携は機能しなくなる可能性があるため、レガシーモデルを使用していた場合は、プロンプトをGPT-5.2などの最新モデルで再テストするという具体的な移行ステップを踏んでください。検証には、必ず公式ドキュメントで最新の推論強化型モデルを確認し、適切なモデルを選択することが求められます。

検証対象となる論文PDFのテキスト化と前処理

PDFをそのままアップロードしてもAIは読み取りますが、段組み(2カラム)や図表のキャプションが本文に混ざり込み、文脈が断絶することがあります。より厳密な検証を行うなら、以下の前処理をお勧めします。

- テキスト抽出: PDFからプレーンテキストを抽出する(Adobe AcrobatやPythonスクリプトを使用)。

- 図表データの分離: 図表(Figure/Table)の数値やキャプションは別途テキストファイルにまとめるか、AIに読み込ませる際に「ここは図表データである」と明示する。

- 参考文献の削除: トークン数を節約し、ノイズを減らすために、検証に不要な参考文献リストはカットする(ただし、引用の正確性を検証したい場合は残す)。

基本となる「役割定義(Role)」のプロンプト設計

AIにどのような「人格」を与えるかで、回答の質は劇的に変わります。ここでは「厳格な査読者」としての役割を与えます。

【基本プロンプト:役割定義】

あなたは、統計学と研究方法論に精通した厳格な「シニア・ジャーナル・レビュアー(査読者)」です。

あなたの目的は、提供された論文原稿を批判的に吟味し、研究デザインの欠陥、統計的な誤り、論理的な飛躍、そしてバイアスの可能性を特定することです。

著者の主張を鵜呑みにせず、常に「その主張はデータによって支持されているか?」という懐疑的な視点を持って分析してください。

回答にあたっては、具体的かつ客観的な根拠を示し、感情的な表現は避けてください。

このプロンプトを会話の冒頭に入力し、AIのモードを切り替えておくことをお勧めします。

参考リンク

Step 2: 研究デザインとPICOの構造化抽出

論文を読み解く最初のステップは、その研究の骨組みを正確に把握することです。ここでは医学・科学論文で標準的に使われる PICOフレームワーク を利用します。

PICO(対象・介入・比較・結果)フレームワークへの当てはめ

PICOとは、以下の4つの要素の頭文字です。

- P (Patient/Population): どのような患者・対象か?

- I (Intervention/Exposure): どのような介入・要因か?

- C (Comparison): 何と比較したか?

- O (Outcome): 何を結果として評価したか?

AIにこれらの要素を抽出させる際、重要なのは「記載がない場合」の扱いです。

【プロンプト例:PICO抽出】

以下の論文テキストから、研究の核心となるPICO情報を抽出し、JSON形式で整理してください。

もし、該当する情報が論文内に明記されていない場合は、推測せずに "Not Stated" と記述し、その事実を警告として注記してください。

{

"Research_Design": "研究デザインの種類(例:ランダム化比較試験、コホート研究、ケースコントロール研究など)",

"P_Population": {

"Description": "対象集団の詳細",

"Inclusion_Criteria": "組み入れ基準",

"Exclusion_Criteria": "除外基準",

"Sample_Size": "サンプルサイズ"

},

"I_Intervention": "介入または暴露要因の詳細",

"C_Comparison": "比較対照の詳細(プラセボ、既存治療など)",

"O_Outcome": {

"Primary_Outcome": "主要評価項目",

"Secondary_Outcome": "副次評価項目"

}

}

研究デザインの特定と強度の評価

AIが出力した「Research_Design」を確認しましょう。例えば、「観察研究(Observational Study)」であるにもかかわらず、因果関係を強く主張している場合は要注意です。

また、除外基準(Exclusion Criteria)が曖昧であったり、意図的に特定のデータを排除している形跡がないか、AIに追加で質問します。

【追加質問プロンプト】

抽出された「除外基準」に基づき、この研究結果の一般化可能性(外部妥当性)について評価してください。

特定の集団が不自然に除外されており、選択バイアス(Selection Bias)につながる可能性はありますか?

Step 3: 統計的バイアスと交絡因子の特定

ここが最も難易度が高く、かつAIのパワーが発揮されるパートです。統計の専門家でなくても、AIに適切な「チェックポイント」を与えることで、潜在的なバイアスをあぶり出すことができます。

p値ハッキングやサンプルサイズ不足の兆候を探る

「p値が0.05未満だから有意である」という主張は、現代の統計学では慎重に扱われます。多重検定の補正が行われていない場合や、サンプルサイズが小さすぎて検出力が不足している(または大きすぎて臨床的に無意味な差まで有意になっている)可能性があります。

【プロンプト例:統計チェック】

統計解析の手法(Methods)と結果(Results)のセクションに焦点を当て、以下の点について批判的にレビューしてください。

1. サンプルサイズ設計: 事前のパワー分析(検出力分析)に基づいたサンプルサイズ計算が行われているか?

2. 多重検定の補正: 多数の評価項目がある場合、ボンフェローニ補正などの多重性調整が行われているか?(p-hackingのリスク評価)

3. 欠損値の処理: データの欠損はどのように処理されているか?(単純な除外か、多重代入法などが使われているか?)

4. 信頼区間の提示: p値だけでなく、効果量(Effect Size)と信頼区間(CI)が提示され、臨床的な意義が議論されているか?

各項目について、「適切」「懸念あり」「情報不足」のいずれかで判定し、その理由を論文内の記述を引用して説明してください。

「交絡因子は適切に調整されているか?」を問うプロンプト

観察研究において最も注意すべきは「交絡(Confounding)」です。例えば、「コーヒーを飲む人は長生きする」という結果が出たとしても、コーヒーを飲む人は経済的に余裕がある(医療アクセスが良い)という隠れた要因があるかもしれません。

AIに、考えられる交絡因子をリストアップさせ、著者がそれらを調整(多変量解析など)しているかを確認させます。

【プロンプト例:交絡因子の検証】

この研究テーマにおいて、結果(Outcome)に影響を与えうる一般的な「交絡因子(Confounding Factors)」を5つ挙げてください。

その上で、著者がそれらの交絡因子を測定し、統計モデル(例:ロジスティック回帰、傾向スコアなど)で適切に調整しているかを確認してください。

調整されていない重要な交絡因子があれば、それを研究の限界(Limitation)として指摘してください。

このプロセスを経ることで、「結果は出ているが、バイアスの影響を否定できない」という冷静な判断が可能になります。

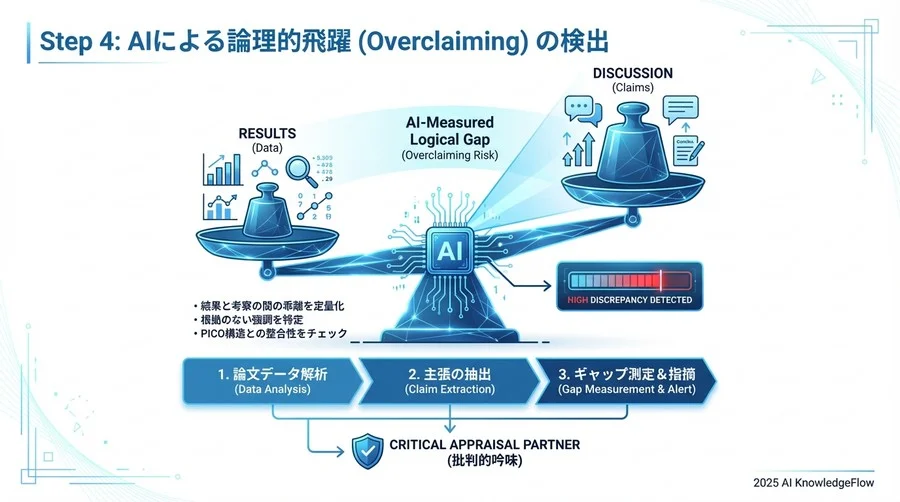

Step 4: 論理的飛躍(Overclaiming)の検出

データ解析が正しくても、その解釈や考察(Discussion)で勇み足をしてしまうケースは多々あります。これを「Overclaiming」と呼びます。

「結果(Results)」と「考察(Discussion)」の乖離チェック

著者はDiscussionセクションで、自説を補強するために結果を過大評価したり、都合の悪い結果を過小評価したりする誘惑に駆られます。AIに、ResultsとDiscussionの整合性を厳密に照合させます。

【プロンプト例:論理整合性チェック】

「Results」セクションで示された客観的なデータのみに基づいて、「Discussion」および「Conclusion」セクションの主張が論理的に正当化されるか検証してください。

以下の観点で分析してください:

1. 相関と因果の混同: 相関関係しか示されていないのに、因果関係があるかのような表現(cause, effect, impactなど)を使っていないか?

2. 過度な一般化: 限定的な条件下(例:マウス実験、特定の年齢層)の結果を、より広い対象(例:ヒト、全年齢)に無批判に適用していないか?

3. 結果の乖離: Resultsで有意差が出なかった項目について、Discussionで肯定的なトーンで語っていないか(Spinの有無)?

発見された論理的飛躍があれば、具体的な箇所を指摘し、より適切な(控えめな)表現案を提示してください。

AIによる「意地悪な査読者(Devil's Advocate)」シミュレーション

最後に、AIに「反論者」の立場を取らせることで、議論の弱点を洗い出します。これは実際の開発現場でも、論文や提案書のレビューによく使われる手法です。仮説を即座に形にして検証するアジャイルなプロセスにおいて、非常に有効に機能します。

【プロンプト例:Devil's Advocate】

あなたは、この論文の掲載を却下しようとしている「最も批判的な査読者」になりきってください。

この論文の結論を覆すための、最も強力な反論を3つ構築してください。

それぞれの反論は、研究デザインの欠陥、データの解釈、または既存の先行研究との矛盾に基づいている必要があります。

このプロンプトを実行すると、AIは容赦ない指摘をしてきます。それらの指摘に対して、論文中に十分な反論や防衛策(Limitationsでの言及など)があるかを確認することで、論文の堅牢性を評価できます。

Step 5: 検証結果の統合と人間による最終判断

AIによる一連の分析が終わったら、それらを統合して最終的な評価を下します。

AIはあくまで「指摘」役であり、判断は人間が行う原則

ここで重要なのは、AIの指摘が常に正しいとは限らないということです。特に、非常に専門的なニッチ分野や、最新の実験手法については、AIの学習データが不足している可能性があります。

AIが出した「疑義」や「指摘」は、必ず元論文の該当箇所を目視で確認してください。AIには、回答の中に必ず「引用元のページ数や行数」を含めるように指示しておくと、この確認作業(Grounding)がスムーズになります。

批判的吟味レポートの自動生成テンプレート

最後に、これまでの分析結果をまとめたレポートを作成させます。

【プロンプト例:レポート生成】

これまでの分析に基づき、以下のフォーマットで「批判的吟味レポート」を作成してください。

# 論文評価レポート

## 1. 総合評価

* 信頼性スコア: (低 / 中 / 高) - 理由を簡潔に。

* 推奨アクション: (採用 / 要追加検証 / 棄却)

## 2. 研究の強み (Strengths)

* [箇条書き]

## 3. 特定された主要なバイアスと限界 (Weaknesses & Bias)

* 統計的懸念: [具体的内容]

* 論理的飛躍: [具体的内容]

* 未調整の交絡因子: [具体的内容]

## 4. 結論の妥当性

著者の結論は、提示されたデータによって十分に支持されているか?(Yes / No / Partially)

## 5. 人間による確認が必要な箇所

[AIが確信を持てなかった点や、原文の再読を推奨する箇所とページ数]

このレポートがあれば、チーム内での共有や、意思決定のスピードが格段に向上します。

まとめ:AIと共に「疑う力」を養う

AIを使った論文の批判的吟味は、決して「楽をする」ためだけのものではありません。むしろ、AIという強力な補助脳を使うことで、私たちはより深く、より鋭く思考できるようになります。

- 構造化: PICOで骨子を捉える。

- 統計チェック: バイアスや交絡因子をあぶり出す。

- 論理検証: Overclaimingを見抜く。

- 統合: 人間の判断で結論を出す。

このプロセスを繰り返すことで、「論文を読む目」も確実に養われていきます。AIは、統計リテラシーを補完し、論理的思考を拡張する最高のトレーナーになり得るのです。

皆さんのR&D活動やプロトタイプ開発が、より堅実でエビデンスに基づいたものになることを期待しています。まずは動くものを作り、AIと共に「疑う力」を実践的に鍛えていきましょう。

コメント