「Copilotが書いたので、動くはずです」

最近、開発現場でこんな言葉を耳にするケースは珍しくありません。開発のスピードは目に見えて上がっているのに、なぜか手戻りやバグ修正のタスクが減らない。そんな違和感を抱いている方も多いのではないでしょうか。

GitHub CopilotやCursorといったAIコーディング支援ツールは、目覚ましい進化を遂げています。単なるコードの補完にとどまらず、複数のファイルにまたがる複雑な作業の計画を立てたり、タスクに合わせて最適なAIモデルを選んだりと、まるで自律的な「コーディングの相棒」のように役割が変化しています。

しかし、ツールがどれほど強力になっても、AIはあくまで「確率的に正しそうなコード」を生成しているに過ぎません。「論理的に正しいコード」であることを完全に保証するわけではないのです。生成されるコードの量と質が向上したからこそ、それが「人間の意図と本当に合っているか」を確認する工程が、これまで以上に重要になっています。この違いを理解して適切な安全網(ガードレール)を設けないと、システムは後から誰も手出しできない複雑に絡み合ったコード(スパゲッティコード)で埋め尽くされてしまう危険性があります。

本記事では、AI時代の開発チームが直面する品質の課題を論理的に解き明かし、実践的なレビューの基準と運用ルールを分かりやすく解説します。AIを「信頼しつつも、しっかりと検証する(Trust, but Verify)」ための仕組み作りについて、実証データに基づいた知見を共有していきましょう。

AIコーディングの「速度」と引き換えに失われる「品質」の実態

多くの開発チームが生産性を高めるためにAIツールを導入し、定型的なコード(ボイラープレート)やテストコードの自動生成で、驚くほどのスピードアップを実感しています。さらに最新の開発環境では、AIが自律的に計画を立てて複数のファイルを編集する機能も急速に普及しています。しかし、その自動化の裏で確実に進行している「品質の低下」に目を向ける必要があります。AIがより複雑な処理を担うようになった今こそ、チーム全体でコードレビューのあり方を見直すタイミングなのです。

生産性向上の裏で増大する「技術的負債」の正体

AIによってコードを書くハードルが下がったことで、設計の意図を十分に理解しないまま、大量のコードがシステムに追加されるリスクが高まっています。

GitClear社が2024年1月に発表した調査レポートでは、AIの普及に伴ってコードの「チャーン(短期間で修正・廃棄される割合)」が増加していることが示唆されています。1億5300万行以上のコード変更を分析した結果、2024年のチャーン率は前年と比較して上昇していました。これは、AIが生成したコードをそのまま追加した後に不具合が見つかり、結局修正を余儀なくされるという現場の実態を明確に表しています。

一般的に、AIツールを導入するとコードの提案(プルリクエスト)の数は増えますが、同時にレビューでの差し戻し回数も増える傾向にあります。一見すると体裁の整った美しいコードが生成されるため、レビューする側もつい油断して承認してしまいがちです。しかし、その結果として、特殊な条件下(エッジケース)でのシステム停止や予期せぬ不具合を引き起こす危険性が潜んでいるのです。

データで見るAI生成コードの脆弱性混入率

スタンフォード大学の研究チームが2023年に発表した論文では、興味深いデータが示されています。AIアシスタントを使用した開発者は、使用しなかった開発者よりも、セキュリティ上の弱点(脆弱性)を含むコードを書く傾向があったのです。さらに厄介なことに、AIを使用した人は「自分のコードは安全だ」と過信する傾向も見られました。

これは「自動化バイアス」と呼ばれる心理現象です。人間は、高度なシステムやAIが生成した情報を無意識に「正しい」と思い込んでしまい、誤った情報に対しても批判的な視点を弱めてしまう性質があります。特に、AIが複数のファイルをまたいで自動修正を行うような最新の環境では、このバイアスがより強く働く懸念があります。

従来のレビュー基準がAIコードに通用しない理由

これまでのコードレビューは、「人間が書いたコード」であることを前提としていました。そのため、存在しないプログラム部品(ライブラリ)を唐突に呼び出したり、プロジェクトの文脈を完全に無視した処理を挿入したりといったミスは稀でした。

しかし、確率に基づいて次の単語を予測する大規模言語モデル(LLM)は、人間にはあり得ない以下のようなミスを犯す性質を持っています。

- ハルシネーション(もっともらしい嘘): 実在しない機能やメソッドを、あたかも公式の仕様書に存在するかのように堂々と使用する。

- 文脈の欠落: プロジェクト独自のセキュリティルールやコーディングの規約を無視し、その場しのぎの不適切な実装を行う。

- 微妙な仕様のズレ: 税込価格で計算すべきところで税抜価格のまま処理するなど、「似ているけれど根本的に違う」ロジックを平然と組み立てる。

「文法的なエラーがないか」「読みやすいか」といった従来の視点だけでは、AI特有の欠陥を見抜くことは困難です。AIが自律的にコードを生成する時代において、レビューする側はコードの表面的な正しさではなく、その背後にある「設計の意図」を厳格に確認するアプローチへとシフトしなければなりません。

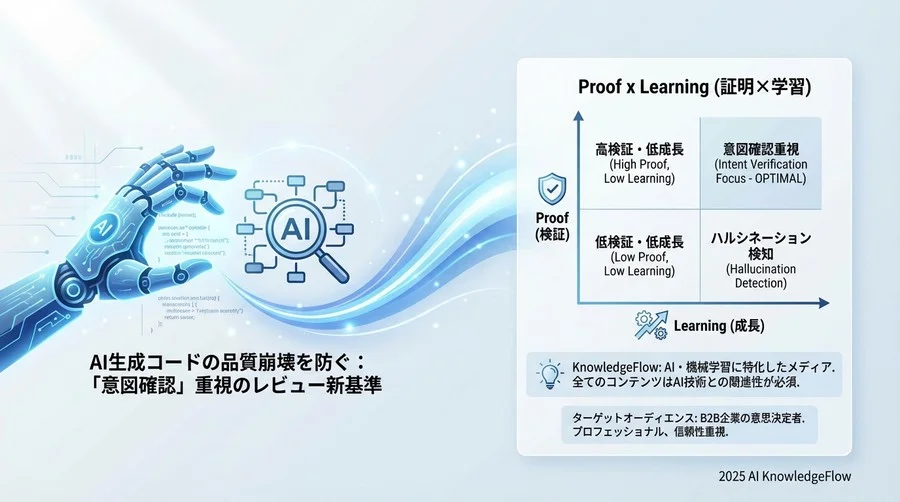

原則:AI時代のレビューは「構文チェック」から「意図確認」へ

AI時代のレビューでは、目的を「コードが正しく動くかの確認」から「設計の意図と合っているかの確認」へとシフトさせることが最大のポイントです。

Human-in-the-loop:人間が担うべき3つの最終防衛線

コードレビューにおいて、人間は以下の3つの領域で「最終防衛線」としての役割を果たす必要があります。

意図(Intent)の検証:

コードがビジネスの要件や設計の意図を満たしているかを確認します。AIは「どう作るか(How)」には強いですが、「なぜ作るのか(Why)」や「何を作るのか(What)」を完全には理解していません。仕様と実際の動きが一致しているかを判断できるのは人間だけです。副作用(Side Effects)の予見:

その変更がシステム全体にどのような影響を及ぼすかを確認します。AIは局所的な最適解を出す傾向があるため、他の機能との連携が壊れたり、処理速度が落ちたりするのを防ぐ大局的な視点が求められます。セキュリティとコンプライアンス:

コードの安全性とライセンスの確認です。AIが生成しがちな脆弱なパターンやライセンス違反のリスクを弾き出し、組織のルールに適合させる責任があります。

「AIが書きました」は免罪符にならない:オーナーシップの明確化

「コードを追加した本人が、その全行について説明責任を持つ」という原則を徹底することが重要です。

「AIが生成したのでよく分からないが、とりあえず動く」という態度は許容されません。AIの出力結果に対する最終的な責任は、あくまで開発者自身にあります。

AIが生成したコードを採用する際は、そのロジックを自分の言葉で説明できなければ追加を認めない、といったガイドラインを設けることをおすすめします。これにより、AIの出力を鵜呑みにせず、中身をしっかり理解するプロセスがチームに定着します。

ブラックボックス化を防ぐ「根拠の明示」義務

実装の「根拠」が分からないと、レビューの難易度は跳ね上がります。AIが生成したコードは、どうしてその結論に至ったのかという思考のプロセスが見えにくく、ブラックボックス化しやすい性質があります。

複雑なロジックをAIに作らせた際は、コードの提案時の説明欄やコメントに「AIにどのような指示(プロンプト)を出したか」や「参考にしたドキュメント」へのリンクを残す運用が効果的です。これにより、レビューする側はAIへの指示の意図を追体験でき、そのコードが妥当かどうかを判断しやすくなります。

ベストプラクティス①:AI特有の「ハルシネーション」検知チェックリスト

ここからは、AIが生成したコードをレビューする際に確認すべき、具体的な「チェックリスト」を紹介します。

存在しないライブラリ・メソッドの呼び出し確認手法

AIの進化は目覚ましく、推論能力は日々向上しています。しかし、マイナーなライブラリや社内独自のフレームワークに関しては、存在しない機能をでっち上げる「ハルシネーション」のリスクが依然として残っています。

場合によっては、名前が似ている悪意のあるプログラム(マルウェア)を含むライブラリを提案してくるリスクすらあります。

チェック項目:

- 読み込んでいるライブラリは実在するか? 公式の配布元(PyPIやnpmなど)で確認したか?

- 指定されたバージョンで、呼び出している機能は本当に使えるか?(古くて非推奨になっていないか?)

- 渡しているデータの型や順番は正しいか?(AIは似たような機能を混同することがよくあります)

実行するまでエラーが出ないプログラミング言語もあるため、見慣れない機能が使われている場合は、必ず公式ドキュメントと照らし合わせる癖をつけるべきです。

セキュリティホールになりうる「見かけ上の正解」のパターン

AIは「とりあえず動くコード」を最優先し、セキュリティ対策を省いた実装を提案することがあります。AIが学習した古いデータの影響で、現代の安全基準を満たさないコードが出力されるケースも珍しくありません。

チェック項目:

- ユーザーからの入力を、そのままデータベースの操作やコマンド実行に渡していないか?

- パスワードやAPIキーなどの機密情報が、コードの中に直接書き込まれていないか?

- 入力チェックに使う正規表現は、処理が重くなってシステムがダウンする攻撃(ReDoS)に対して弱くないか?

- 暗号化の仕組みは、最新の推奨基準に従っているか?(古い方式を使っていないか?)

特に、ログインや権限確認などのセキュリティに関わる部分は、人間が厳密にチェックする必要があります。

エッジケースと境界値テストの網羅性検証

AIは、一般的な正常なパターン(Happy Path)のコードを書くのは得意ですが、特殊な条件や異常が起きた時の考慮が甘い傾向があります。複雑なビジネスのルールの隅々まで、AIが自律的にカバーすることは困難です。

チェック項目:

- データが空だったり、存在しなかったりする場合の処理は書かれているか?

- 数値の計算で、ゼロで割ってしまったり、桁あふれを起こしたりする対策はされているか?

- 繰り返し処理が、永遠に終わらなくなる(無限ループ)リスクはないか?

- 複数の処理が同時に走った時に、データが矛盾する問題(競合状態)は考慮されているか?

レビューする側は、「もしデータが空だったらどうなるか」「通信が途切れたらどうなるか」といった意地悪な視点でコードを確認することが大切です。

ベストプラクティス②:コンテキスト理解を促す「Why重視」のPR作成ルール

レビューの品質を上げるためには、コードを提案する(プルリクエストを作成する)側の工夫も欠かせません。AIを活用した開発プロセスにおいて、提案の品質を一定に保つための実践的なルールを解説します。

最近のAIツールは、複数のAIモデルを選べたり、自律的にコードを生成・編集できたりと、機能が急速に進化しています。AIが生成するコードの規模や複雑さが増しているからこそ、コードを書く側が「なぜこのロジックが正しいと言えるのか」を言葉にし、レビューする側に意図を伝える仕組みが重要になります。

AI生成部分と人間修正部分の明確な区分け

提案の中に、AIが生成したコードと人間が手作業で書いたコードが混ざっていると、レビューする側はどこを重点的に確認すべきか迷ってしまいます。そのため、提案の説明欄に以下のような区分けを設けるテンプレートの導入をおすすめします。

## AI活用の有無

- [x] AI生成コードを含む

- [ ] すべて人間が記述

## AI生成箇所とその検証内容

- `utils/data_processor.py` の `process_data` 関数:Copilotで生成。

- 検証:単体テストを追加し、正常系・異常系(空データ)の動作を確認済み。

このように明示することで、レビューする側は「AIが生成した部分は、もっともらしい嘘や特殊な条件の考慮漏れがないか重点的にチェックしよう」と、明確な戦略を立ててレビューに臨むことができます。

「なぜこの生成結果を採用したか」のコメント義務化

AIが提示したコードを何も考えずに貼り付けるのではなく、そのコードを採用した理由をコメントややり取りの中に残すルールを設けます。

例えば、複雑な入力チェックの条件をAIに書かせた場合は、以下のように記述します。

# AI生成:メールアドレスの入力チェック

# 採用理由:標準的な規格(RFC 5322)に準拠しており、自社の要件を満たしていることをテストで確認済み

pattern = r"^[a-zA-Z0-9_.+-]+@[a-zA-Z0-9-]+\.[a-zA-Z0-9-.]+$"

「採用した理由」と「検証した事実」をセットで書くことで、開発者自身が思考停止に陥るのを防ぐ効果があります。同時に、レビューする側に対しても「しっかり意図を持って実装されたコードである」という安心感を提供できます。

複雑度(Cyclomatic Complexity)の制限値設定

AIは時に、人間には理解しがたいほど複雑なコードを一瞬で生成することがあります。これを防ぐために、コードの複雑さを自動で計測するツールを用いて上限値を設定し、基準を超えたコードは書き直し(リファクタリング)を強制する仕組みが有効です。

「AIが書いたから複雑でも仕方ない」と妥協するのではなく、「人間が将来にわたってメンテナンスできないコードはシステムに組み込まない」という断固たる姿勢をチーム全体で共有することが、長期的なコード品質の維持につながります。

ベストプラクティス③:ジュニアエンジニアの育成とレビュー品質の両立

AIツールが普及したことで、「AIに聞けば答えが出る」環境になり、若手エンジニアの基礎的な思考力が育たないのではないかという懸念の声をよく耳にします。

「AI鵜呑み」を防ぐペアプログラミング・レビュー

若手の育成においては、若手が手を動かし、ベテランがサポートする「AIを使ったペアプログラミング」が効果的です。

ベテランが「AIの提案は本当に正しいかな?」「この書き方だと処理速度はどうなると思う?」と問いかけ続けることで、若手はAIの出力を批判的に評価する視点を養うことができます。

シニアによる「AIコード添削」のフィードバックループ

コードレビューを絶好の教育の機会と捉え、ベテランは「なぜAIはこういうコードを書いたのか」「どう指示を出せばもっと良くなったか」をフィードバックします。

「この繰り返し処理はメモリの効率が悪いから、別の書き方をするようにAIへの指示(プロンプト)を修正してみて」と具体的に指導することで、AIを使いこなすスキルと、コンピュータサイエンスの基礎知識を同時に高めることができます。

レビューガイドラインを教育資料として活用する

チームで定めた「AIコードレビュー基準」や「チェックリスト」は、そのまま優れた教育資料になります。これらを文書化して新メンバーの受け入れプログラムに組み込むことで、チームとしてのAIとの向き合い方を早期に理解してもらえます。

実践ガイド:手戻りを防ぐ「AI査読プロセス」と最新ワークフロー

AIツールの導入は生産性を高める一方で、適切なプロセスがないと品質の低下を招きます。ここでは、効果的な検証プロセスと、最新機能を活用した品質管理のアプローチを論理的に解説します。

よくある課題:AI導入後のバグ混入とレビュー負荷

AIを導入した組織では、コーディングの速度が上がるのと引き換えに、テスト工程でのバグ検出数が増加する傾向があります。経験の浅いエンジニアによるセキュリティチェックの甘さや、厳密な計算が求められるシステムでの数値の丸め誤差などの見落としが散見されます。

結果としてレビューする側の負担が増大し、リリースが遅れてしまう事態に陥ります。これはツールの問題ではなく、AIが生成したコードに対する「検証プロセス」が欠如していることが根本的な原因です。

導入すべき3つの基準と最新機能の活用

こうした課題を防ぐため、以下の3つの基準を設け、最新機能を活用することを推奨します。

「AI生成箇所の明示」と責任範囲の明確化

コードの提案内でAIが生成した箇所を明示し、提出者がコードの動きを完全に説明できる状態をルール化します。「なぜ動くのか」を理解していることが必須条件です。エージェント機能と連携ツールによる「事前検証」

AIが自律的に動くエージェント機能を活用し、人間にレビューを依頼する前にコードの品質を高めます。開発環境からコードの整理や仕様書の更新をAIに任せ、AI自身に整合性をチェックさせます。

また、外部ツールと連携する仕組み(MCPなど)を使って、要件定義やAPIの仕様書と直接連携させることで、AIがもっともらしい嘘をつくリスクを減らすことができます。AI間の連携設計(ダブルチェック)

複数のAIモデルを使い分けるアプローチも非常に有効です。例えば、一つのAIでコードを実装し、別の高度なAIモデルを使ってロジックの妥当性やセキュリティの穴を検証させます。人間がレビューする前に「AIによる相互レビュー」を挟むことで、問題のあるコードを事前に弾くことができます。

期待される効果:レビュー効率化と品質向上

このプロセスを徹底することで、コードを提出する前の自己レビューの質が劇的に向上します。適切な検証プロセスを導入したチームでは、実証データとしてもレビュー時間の短縮や手戻りの減少が確認されています。「バグが起きてから直すより、ルールで未然に防ぐ方が結果的に速い」という意識をチーム全体で共有することが、成功の鍵となります。

成熟度評価と次のステップ

最後に、チームの現在のレベルと、次にどのようなステップを踏むべきかを示すロードマップを提示します。

チームの「AI品質リテラシー」診断チェック

- Level 1(導入期): メンバーが個別にAIツールを使っており、チームとしての共通ルールがない状態。

- リスク: 管理されていないAIコードの増殖、セキュリティリスク、作業の属人化。

- Level 2(統制期): AI使用のガイドラインがあり、セキュリティチェックを実施している状態。

- 課題: レビューの負担が高く、精度がレビューする人のスキルに依存してしまう。

- Level 3(最適化期): 自動テストやシステムの自動更新プロセスにAIのチェックが組み込まれ、人間はより高度な設計レベルのレビューに集中できている状態。

- 目標: 持続可能な開発体制の構築と、開発者の体験(DevEx)の向上。

段階的導入のロードマップ

Level 1のチームは、ルールが形骸化するのを防ぐため、まずは「AIを使用したことの明示」と「基本的なセキュリティチェックリスト」の導入から始めましょう。

Level 2に進んだら、コード提案時のテンプレートを整備したり、ペアプログラミングでの教育を強化したりします。最終的には、コードを自動で解析するツールやAIによる自動レビューを導入し、Level 3の最適化された状態を目指します。

自動化ツールとの棲み分け戦略

AI時代の品質保証は、構文チェックツール、セキュリティスキャナ、そして人間のレビューを組み合わせた「多層防御」が鍵となります。

AIの技術が進化するのに合わせて、人間側もレビューの手法を常にアップデートし続ける必要があります。今回紹介した基準を第一歩として、ぜひ皆さんのチームに最適な「AIとの協働モデル」を築き上げてください。

最後までお読みいただきありがとうございました。この記事が、皆さんの開発現場における品質向上の一助となれば幸いです。

コメント