はじめに:実データ収集の限界と「合成データ」という突破口

ドローンソリューションの開発現場において、以下のような課題に直面することは少なくありません。

「雨天時の自律飛行精度を上げたいけれど、高価な機体をわざわざ雨の中で飛ばして水没させるわけにはいかない」

「橋梁点検AIを作りたいのに、ひび割れや錆のある画像がどうしても集まらない」

多くの現場でCGシミュレータが導入されていますが、シミュレーション画像と実写画像の間にある「ドメインギャップ(Domain Gap)」の壁は厚く、そのままでは実機での推論精度が上がりきらないのが現実です。

ここで、GAN(Generative Adversarial Networks:敵対的生成ネットワーク)という技術が活用できます。

最近は生成AIといえばLLMやDiffusion Modelが話題ですが、特定のドメイン変換や、構造を維持したままのテクスチャ変換において、GANは有効な手段です。「見破られないほど精巧なディープフェイクを作る技術」は、「AIを騙せるほどリアルな訓練データを作る技術」とも言えます。

この記事では、メディアフォレンジック(媒体分析)の知見を、「生成」側に応用します。理論の解説は最小限にとどめ、「LLMにGANの実装コードを書かせるためのプロンプトテンプレート」を紹介します。

複雑なGANの調整にかかる工数をショートカットし、ドローン開発に必要な「悪天候データ」や「異常検知データ」を効率的に量産する。そのような実用的なワークフローを構築していきましょう。

1. 本テンプレート集の活用とドローン開発における「合成データ」の意義

なぜ実写データだけでは不十分なのか

ドローンの物体認識や制御モデルにおいて、実写データだけで対応することには限界があります。専門家の視点から言えば、以下の3つの課題が大きな障壁となるからです。

- 網羅性の欠如(カバレッジ不足): 晴天時のデータは豊富でも、豪雨、濃霧、逆光、夜間といった「本当にAIに学習させたい悪条件」のデータは、意図的に集めるのが困難です。

- 安全性リスク: 故障予兆検知のために、実際にプロペラを破損させて飛ばすのは、安全面で大きなリスクがあります。

- アノテーションコスト: 膨大な実写データに対して、ピクセル単位でセマンティックセグメンテーションを行うコストと時間は、プロジェクトの予算を圧迫する可能性があります。

GANを活用すれば、手持ちの「晴天・正常」データをベースに、「雨天・異常」データを生成し、これらのギャップを埋めることができます。特に、CGシミュレータで生成した画像をGANに通して「実写風」に変換するSim2Real(Simulation to Reality)のアプローチは、コスト削減の有効な手段となります。

LLMを活用したGAN実装のワークフロー

GANの実装、特にCycleGANやStyleGANの調整は簡単ではありません。ハイパーパラメータの設定が難しく、ゼロから構築しようとすると「学習が収束しない」「モード崩壊した」といった問題に直面することは珍しくありません。

しかし、ChatGPTやClaudeの最新モデルを活用することで、実装のハードルは劇的に下がります。

最新のLLM(大規模言語モデル)は、抽象的な推論能力やコーディング性能が飛躍的に向上しています。特にClaudeの最新モデルにおける自律的なコーディング支援機能や、ChatGPTの強化されたコンテキスト理解能力は、複雑なディープラーニングモデルの実装において強力なツールとなります。かつては多大な時間を要していたコード調整も、適切な指示を与えれば短時間でプロトタイピングが可能になりつつあります。

本記事で紹介するテンプレートは、こうした最新LLMの特性を最大限に引き出すよう設計されています。以下のワークフローで、即座に実装に着手することが可能です。

- 要件定義: 「どんなデータが足りないか」を明確にする。

- プロンプト入力: 本記事のテンプレートをLLMに入力し、PyTorchコードを生成させる。

- 学習実行: 手持ちの少量のデータでGANを学習させる。

- データ生成: 学習済みモデルでデータを量産し、ドローンAIの学習セットに追加する。

本記事で生成するデータセットの種類

今回は、ドローン開発の現場で特に課題となりやすい、以下の2パターンに絞って解決策を提示します。

- 環境変化データ: 晴天 → 雨・霧・夜間への変換(CycleGAN)

- 異常検知データ: 正常なインフラ画像 → ひび割れ・錆の合成(Inpainting/Pix2Pix)

2. 【要件定義・設計】モデル選定とアーキテクチャ設計プロンプト

GANには多種多様な派生モデルが存在します。流行りのモデルに飛びつくのではなく、目的に合致したモデルを選ばないと、計算リソースを無駄にする可能性があります。まずは、タスクに応じて適切なアーキテクチャを選定・設計するためのプロンプトを紹介します。

タスクに応じた最適なGANモデルの選定

- CycleGAN: 「対(ペア)」になる画像がない場合に最適です。「A地点の晴れの画像」と「B地点の雨の画像」から、晴れを雨にするルールを学習します。ドローンの飛行環境変換に適しています。

- Pix2Pix: 「対(ペア)」画像が必須です。シミュレータ画像(CG)とそれに対応する深度マップなど、完全に位置合わせができたデータがある場合に有効です。

- StyleGAN2/3: ゼロから高解像度の画像を生成します。特定の背景やオブジェクトをランダムに生成したい場合には向いていますが、既存の画像を加工する用途(Image-to-Image)には工夫が必要です。

プロンプトテンプレート:アーキテクチャ選定と基本設計

以下のプロンプトをLLMに入力し、プロジェクトの要件に合ったモデル構造とライブラリ構成を提案させてみてください。

# プロンプトテンプレート: GANモデル選定とアーキテクチャ設計

あなたはコンピュータビジョンと生成モデル(GAN)の専門家です。以下のドローン開発プロジェクトの要件に基づき、最適なGANモデルの選定と、PyTorchでの実装アーキテクチャを提案してください。

## プロジェクト要件

1. 目的: [例: ドローンの空撮画像における、昼間の画像を夕方や夜間の画像に変換し、データセットを拡張したい]

2. 入力データ: [例: 解像度1920x1080のRGB画像。ペアとなる正解データ(同じアングルの夜間画像)は存在しない]

3. 制約条件: [例: GPUメモリは16GB。推論速度よりも生成品質(リアリティ)を重視]

4. ターゲット: [例: 物体検出モデル(YOLOv8)の学習用データとして使用]

## 依頼内容

1. このタスクに最適なGANモデル(CycleGAN, Pix2Pix, UNIT, MUNITなど)を選定し、その理由を論理的に説明してください。

2. 選定したモデルのGeneratorとDiscriminatorの推奨アーキテクチャ(ResNetブロック数やレイヤー構成)を提示してください。

3. 学習を安定させるための推奨テクニック(Spectral Normalization, Instance Normalizationなど)を挙げてください。

このプロンプトを使えば、技術選定のミスマッチを防ぎ、手持ちのGPUリソースで現実的に動かせる設計図が手に入ります。

3. 【実装テンプレートA】悪天候・環境変化データの生成(CycleGAN)

ドローン開発で最も需要が高いのが「悪天候データ」です。ここでは、ペア画像が不要なCycleGANを用いて、手持ちの「晴天画像」を「雨天画像」に変換するコードを生成します。

晴天画像を雨天・霧・夜間に変換する

CycleGANの利点は、ドメインA(晴れ)とドメインB(雨)の画像群さえあれば、それらが同じ場所で撮影されたものでなくても、スタイルの変換学習ができることです。つまり、ネット上のフリー素材や過去のアーカイブから雨の画像を集めるだけで学習が始められます。

実装コード生成プロンプト

以下のプロンプトは、PyTorch Lightningなどのフレームワークを指定して、可読性が高く管理しやすいコードを出力させるように設計しています。

# プロンプトテンプレート: CycleGANによる悪天候データ生成実装

あなたはAIエンジニアです。PyTorch (またはPyTorch Lightning) を使用して、ドローン画像のためのCycleGAN学習コードを実装してください。

## タスク詳細

- 入力ドメイン (Domain A): 晴天時のドローン空撮画像

- 目標ドメイン (Domain B): 雨天・霧などの悪天候画像

- 目的: Domain Aの画像をDomain Bのスタイルに変換し、訓練データを拡張する

## 実装要件

1. モデル構造:

- Generator: ResNetベース(9ブロック推奨)

- Discriminator: PatchGAN (70x70)

2. 損失関数:

- Adversarial Loss (MSEまたはBCE)

- Cycle Consistency Loss (L1 norm, 重み: lambda_A=10, lambda_B=10)

- Identity Loss (色味の維持のため必須, 重み: 0.5 * lambda)

3. データ拡張:

- RandomCrop, RandomHorizontalFlip を適用

- 画像サイズは 512x512 にリサイズ

4. 出力アーティファクト: 学習過程で生成画像を `wandb` または `tensorboard` にログ保存する機能

## 出力してほしいコード

- Datasetクラスの実装

- Generator/Discriminatorクラスの定義

- 学習ループ(Training Loop)のメインコード

## 注意点

- 雨の筋(Rain Streaks)や霧の白みが自然に表現されるよう、Instance Normalizationを使用してください。

ドメイン固有の損失関数設定

上記のプロンプトにある「Identity Loss」は、重要な役割を果たします。これが欠けると、空の色を変えるだけでなく、ドローンが認識すべき「建物」や「車」の形状まで歪めてしまう可能性があります。

メディアフォレンジックの視点で見ると、生成された画像の周波数成分に不自然な偏り(チェッカーボードアーティファクトなど)がないかを検証する技術的検知手法も重要になりますが、まずはIdentity Lossで「構造維持」を強制することが、実用的なデータを作る第一歩です。

4. 【実装テンプレートB】インフラ点検用「異常箇所」の合成(Inpainting/Pix2Pix)

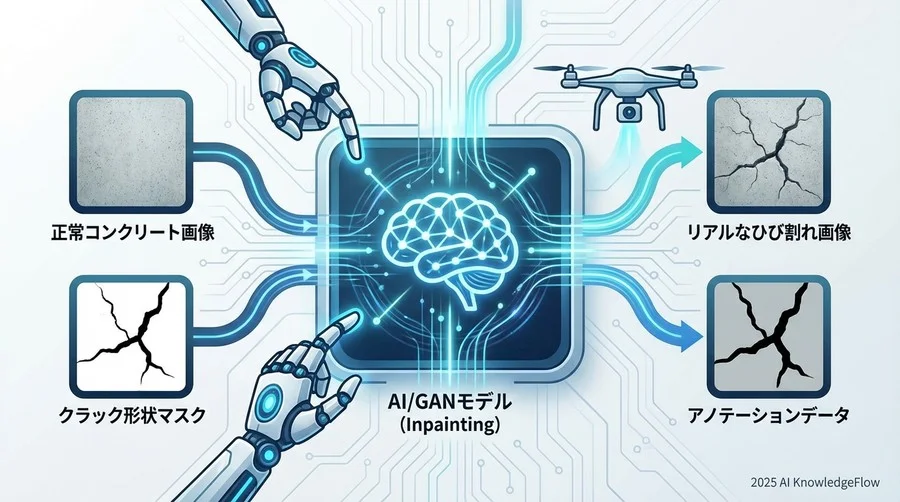

次に、インフラ点検ドローンなどで求められる「構造物の異常(ひび割れ、錆)」のデータ生成です。これは画像全体の色味を変える天候変換とは異なり、局所的で繊細な操作が必要になります。

正常な橋梁・鉄塔画像へのクラック(ひび割れ)合成

ここでは、正常なコンクリート表面の一部をマスクし、その部分だけにひび割れを生成するInpainting(画像補完)技術、あるいは条件付きGAN(cGAN)を応用します。

マスク画像を用いた局所的な生成指示

異常データを生成する際のメリットは、同時に「どこが異常か」を示すアノテーション(正解ラベル)も自動生成できることです。

# プロンプトテンプレート: 異常箇所合成のためのInpainting/Pix2Pix実装

あなたは画像処理エンジニアです。インフラ点検AIの学習用に、正常なコンクリート画像に「ひび割れ(Crack)」を合成するパイプラインを構築してください。

## 手法

- アプローチ: マスク画像を用いた条件付きGAN (Pix2Pix または Partial Convolution Inpainting)

- 入力:

1. 正常なコンクリート画像 (Background)

2. ひび割れ形状のバイナリマスク (Mask) - ランダム生成またはテクスチャ素材から取得

## 実装要件

1. Generator: U-Net構造(Skip Connectionあり)。入力されたマスク領域に対してのみ、リアルなひび割れテクスチャを生成・合成する。

2. Discriminator: 合成された領域と周辺の境界が自然かどうかを判定するLocal Discriminatorと、画像全体を見るGlobal Discriminatorを組み合わせる。

3. データセット生成フロー:

- 正常画像にランダムな位置でマスクを適用

- GANでひび割れを生成

- 生成した画像と、使用したマスクをペアにして保存(これをそのままセグメンテーションタスクの教師データにする)

## 出力コード

- マスク画像をランダム生成・合成する前処理関数のPythonコード

- Pix2Pixスタイルの学習モデル定義

- 生成された画像とマスクをセットで保存するスクリプト

このアプローチの利点は、「アノテーション作業が不要になる」ことです。合成時に使用したマスクそのものが、ピクセル単位の正確な正解ラベルとなるため、教師あり学習のコストを大幅に削減できます。

5. 【品質評価・調整】生成データの検証とハイパーパラメータ最適化

GANで生成した画像をそのまま学習に使うのは、リスクが伴います。「モード崩壊(Mode Collapse)」により、同じような画像ばかり生成されていたり、人間にはリアルに見えてもAIにとってはノイズだらけだったりする可能性があるからです。

FIDスコア計算の実装

生成画像の品質と多様性を定量的に評価する指標として、FID (Fréchet Inception Distance) が使われます。FIDが低いほど、実画像に近い分布を持っていることを示します。

# プロンプトテンプレート: 生成画像の品質評価 (FIDスコア)

GANで生成された画像セットの品質を評価するために、FID (Fréchet Inception Distance) スコアを計算するPythonスクリプトを作成してください。

## 要件

1. ライブラリ: `pytorch-fid` または `torchmetrics` を使用。

2. 入力:

- 実画像フォルダのパス

- 生成画像フォルダのパス

3. 機能:

- InceptionV3モデルを用いて特徴量を抽出

- 2つの分布間の距離を計算して出力

4. 追加機能:

- 生成画像の中に「真っ黒」や「ノイズのみ」の失敗作が含まれていないかチェックする簡易的なフィルタリング関数も含めてください。

モード崩壊(Mode Collapse)への対策

もし生成される雨の画像がどれも同じような降り方になってしまった場合、それはモード崩壊です。この場合、LLMにデバッグを依頼することを検討してください。

デバッグ用プロンプト例:

「CycleGANの学習において、Generatorの損失は下がっていますが、生成される画像の種類が乏しく、同じパターンの繰り返しになっています。これを解消するための『Diversity Regularization』の実装方法や、Discriminatorの更新頻度調整についてアドバイスと修正コードを提示してください。」

6. 実践ワークフロー:生成データを用いたモデル再学習

最後に、生成したデータを実際の物体検出モデル(YOLOやSSDなど)の学習にどう組み込むか、実践的なワークフローを解説します。

実データと合成データの混合比率

合成データを100%にして学習させると、実環境での精度はむしろ下がることがあります。合成データ特有のアーティファクト(微細なノイズパターン)をモデルが過学習してしまうためです。

合成データはあくまで「補助」であり、実データの分布の隙間を埋める役割を果たすことが望ましいです。

ドローン搭載モデルへのデプロイ前検証

- ベースライン評価: 実データのみで学習したモデルの精度を計測(テストセットA)。

- 混合学習: 実データ+合成データで学習。

- 検証: テストセットA(通常環境)での精度が落ちていないか確認しつつ、テストセットB(悪天候・希少ケースの実データ)での精度向上を確認する。

重要なのは、「通常の晴天時の性能を劣化させずに、悪天候時の性能を向上できているか」という点です。

まとめ:AIに「データを作らせる」技術を武器にする

ディープフェイク技術は、偽情報の拡散や社会的な信頼の毀損といった重大な社会的リスクをもたらす脅威として語られることが多いですが、その中核技術であるGANは、適切に活用すればドローン開発における「データ不足」という課題を解決する実用的な手段となります。

今回紹介したプロンプトテンプレートを活用すれば、高度なGANの理論をすべて理解していなくても、データ生成パイプラインを構築することが可能です。AI開発の現場では、データを「集める」ことから、AIを使ってデータを「設計・生成する」ことへと進化しています。

しかし、生成データの品質管理や、実データとの最適な混合戦略には、メディアフォレンジックの知見を活かした適切な解析と調整が必要です。技術的検知手法を用いて生成データの不自然さを排除し、安全かつ高精度なAIモデルの構築を目指してください。

コメント